【活動報導】AI PC搭OpenVINO 在邊緣輕鬆部署LLM!

為了讓開發者更充分了解如何在自己的AI PC上發揮Intel最新版本OpenVINO開發平台的效能以實現更多創新應用,MakerPRO與Intel共同舉辦了以「探索AI PC新時代,學習在邊緣裝置輕鬆運作LLM」為題的第四場OpenVINO DevCon線上講座。

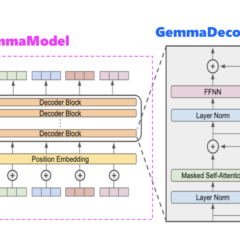

為什麼Gemma採取Decoder-Only Transformer架構呢?

本篇文章會說明Gemma為何會採取Decoder-Only Transformer架構,並針對Decoder-Only Transformer架構進行介紹。

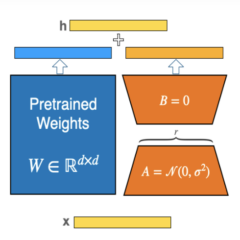

如何從0訓練企業自用Gemma模型

Gemma模型是Text到Text的大型語言模型,非常適合各種文本生成任務。其有多種使用途徑,包括使用新資料來微調Gemma模型、拿Gemma開源程式碼,而從頭開始訓練它,本文將介紹如何從0訓練企業自用Gemma模型。

Nvidia GTC 2024 提出的 FP8/FP4 如何加速AI訓練及推論

新一代 GPU Blackwell B200 在硬體端提供了 FP4 計算能力,單片就可達 20 petaFLOPS,二片 B200 組成的 GB200 在訓練性能是前一代 H100 的 4 倍,推論性能更高達 7 倍。若再將 36個 CPU 加上 72 個 GPU 組成「GB200 NVL72」超大型伺服器,則 FP8 訓練能力可高達 720 petaFLOPS, FP4 推論能力更高達1.44 exaFLOPS。而究竟什麼是 FP8 / FP4 呢?本篇文章會簡單幫大家科普一下。

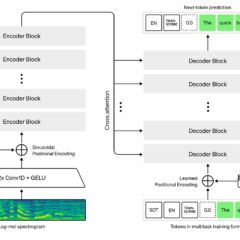

用OpenVINO與NNCF最佳化Whisper語音辨識模型

本文示範如何以OpenVINO與Optimum Intel載入並執行Whisper與Distil-Whisper模型進行音訊轉錄任務,以及如何使用NNCF對這些模型執行INT8訓練後量化;接著在橫跨多種CPU的裝置上以大規模語音轉文字資料集評估這些模型。