如何選擇最適合你的AI推論模型量化方案?

AI推論模型主要透過量化(Quantization)、修剪(Pruning)和聚類(Clustering)三種方式進行最佳化,本文提出一個決策樹,幫助你選擇最適合的量化技術。

TensorFlow Lite全面支援半精度(FP16)運算,可將設備端推論性能翻倍

TensorFlow團隊宣佈,TensorFlow Lite 和 XNNPack 全面支援FP16的半精度推論(Half Precision Inference),同時指出,透過在 ARM CPU 上啟用半精度推論,能將TensorFlow Lite 的XNNPack backed的浮點推論性能提高一倍。

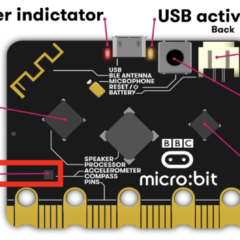

【MakeCode】在micro:bit上實作混成(blended)計步器

本文將帶領讀者們在一塊 micro:bit 主板上體驗由 MakeCode 平台提供的積木(Blocks)、靜態型別腳本(Static TypeScript,STS)和 Static Python(SP)三種程式語言開發工具,以 micro:bit 最著名的計步器範例展示。

活用IPEX和Intel GPU加速大型語言模型訓練效率

以IPEX (Intel-Extension-for-PyTorch)搭配Intel硬體產品,可提供最佳化功能大幅提升運作效能。例如透過PyTorch的