不只是評估套件?BrainChip推出Akida Edge AI Box閘道器

BrainChip與VVDN Technologies合作,推出了Akida Edge AI Box,本篇文章,就會簡單介紹這款AI Box給各位認識。

【Edge AI專欄】從CES 2024 看Edge AI及TinyML最新發展趨勢

今年CES的主軸:人工智慧、數位健康、永續發展、汽車科技、遊戲與電子競技、擴增/虛擬實境、智慧城市、智慧家居等領域最新技術。為了讓大家更了解在邊緣智慧(Edge AI)和微型機器學習(TinyML / MCU AI)的最新趨勢,本篇文章簡單盤點了此次四十多項較具代表性的產品讓大家認識一下。

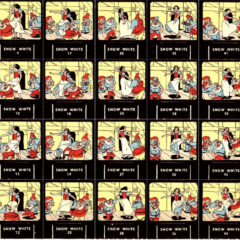

GIF動畫從頭說起-細說翻頁書的歷史(上)

翻頁書(FLIPBOOK)翻書動畫或拇指書,是一種介於書籍和電影之間的藝術形式,主要是利用一組照片或畫面通過翻轉來產生運動的錯覺,讓簡單的畫面產生動畫的效果。

不怕離線!100%在樹莓派上執行的LLM專案

ChatGPT掀起一波LLM熱潮,但LLM運作需要龐大運算力,因此目前多是在雲端上執行。不少人希望LLM也能在本地端執行,如此就不怕斷線、洩漏隱私、內容審查、誤導等缺點。本篇文章,就會介紹創客如何利用樹莓派執行的LLM專案!