以3D感知開啟智慧機器人新時代:從深度相機到OpenVINO的邊緣智慧革命

在機器人技術的發展長河中,有些時刻象徵著技術能力的本質躍升:從2D視覺到深度學習、從手工特徵到端對端模型、從依賴雲端到邊緣運算。而如今,我們正站在另一個重大轉折點的前端——3D 空間感知與即時推論的全面融合

有了Intel AI Playground 不寫程式也能輕鬆玩生成式AI

Intel整合自家NPU/GPU硬體強大算力及OpenVINO開源推論工具套件,開發出一套「AI Playground」,讓聊天對話、文字生成影像及影像強化輕輕鬆鬆就能完成。

【實作案例】以OpenVINO實現VLM、MLLM導入產業應用

本文從技術原理出發,結合理論與實測,展示了如何以Phi-3 Vision為核心模型,配合OpenVINO部署最佳化與YOLOv8偵測模組,建構可實際落地的多模態語言模型應用架構。

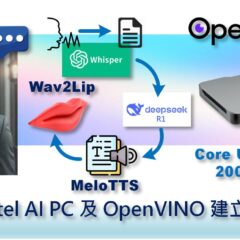

輕鬆用Intel AI PC及OpenVINO建立數位分身

一個完整的數位分身,就像真人一樣,要具有自然語言對話、豐富肢體動作和產生生動表情的能力,其中就需要用到許多生成式AI技術,包括利用語音轉文字(STT)得到問題的文字,交給大語言模型(LLM)進行文字問答,再將文字轉語音(TTS)把答案讀出,最後再配合語音自動對嘴形(Lip Sync)讓人物影像的嘴巴也能和語音同步動起來。

【開箱評測】探索未來:結合迷你PC與生成式AI的個人多媒體助理

以mini PC作為多媒體AI個人助理的應用,展現了AI技術日益貼近日常生活的趨勢,未來這類設備將在提升個人生活品質和工作效率方面扮演越來越重要的角色,而本文將分析NUC BOX-155H這台mini PC在多媒體處理上的效能,並且分享一個未來十分看好、能成為個人多媒體助理的AI模型:Stable Diffusion及其多個版本的發展與應用選擇。

OpenVINO 2024.2姿態模型效能評估:以OpenPose、YOLOv8與3D-Pose為例

本文主要於ASRock NUC BOX-155H平台進行,使用Intel Core Ultra運作的NUC (下一代計算單元)。我們將姿態辨識模型OpenPose、3D Pose、MoveNet 與 YOLOv8 模型轉換為OpenVINO IR模型格式,分別在CPU、iGPU及NPU上進行部署。觀察這些模型在CPU、iGPU及NPU的硬體效能差異,透過實際執行影片推論的過程,觀察NPU的性能表現。