【Arm的AI世界】重新思考CPU在AI中的角色:在DGX Spark上實作實用的RAG

本文將深入解析基於CPU的嵌入、統一記憶體與本地檢索工作流程如何相互串接,在桌機級AI平台上打造反應迅速、兼顧隱私的RAG流水線——並由Arm與DGX Spark驅動運算。

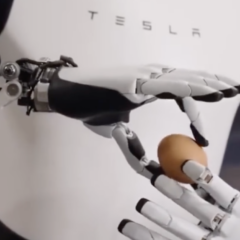

【Podcast】機器人的巧手革命:靈巧手如何推動實體 AI 崛起

在這集精彩的 Podcast 節目中,我們探討 機器人靈巧手(Dexterous Hands) 的最新進展,揭示它如何成為實體 AI 與通用機器人技術的關鍵突破。

Microchip讓MCU與MPU具備邊緣智慧決策能力

Microchip Technology宣布擴展其Edge AI產品陣容,推出涵蓋軟硬體與工具的Edge AI全套解決方案,協助開發人員以其微控制器(MCU)與微處理器(MPU)快速打造可量產部署的應用…

MakerPRO「2025台灣Edge AI開發者調查」初探

《MakerPRO》針對廣大的開發者進行了一項問卷調查,目的是了解現階段各路Maker們在Edge AI領域的運用現況;本文將探索初步統計結果,之後也會將更詳細的完整報告內容提供給熱情參與這次調查的朋友以及網站會員!

戰略決策AI進化:Palantir AIP如何導入LLM重塑現代戰場指令

過去,分析官需要手動比對衛星圖與電訊截獲,現在Palantir AIP 利用LLM將這些流程簡化為直觀的對話,此模式徹底改變了決策流程。例如,在 2024 年的一場實戰模擬中,AI 將原本需要 10 名分析官運作數小時的「目標確認與打擊方案擬定」縮短到了不到 1 分鐘。

從展示走向實用的Boston Dynamics Atlas

過去,人形機器人更多被視為技術的象徵,用來證明「做得到什麼」;而如今,產業開始關注人形機器人能否真正「派上用場」。在這樣的轉變過程中,Boston Dynamics所開發的Atlas,無疑是最具代表性的存在之一。