LangChain框架已正式支援OpenVINO!

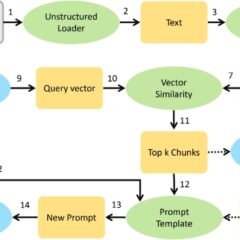

透過LangChain,開發者可以輕鬆構建基於RAG或者Agent流水線的複雜應用體系,而目前我們已經可以在LangChain 的關鍵元件LLM、Text Embedding和Reranker中直接呼叫OpenVINO進行模型部署!

【2024 MAI Talks】企業LLM落地關鍵:模型微型化技術

Deep Mentor CEO吳昕益分享了企業將大型語言模型(LLM)落地部署需要的關鍵技術,深入介紹模型微型化技術的特點。

【負責任的AI】避免人工智慧誤用、濫用!已有國際標準可循

其實科技也有許多副作用,例如大數據雖然可以使廣告投放更加精準,但也有了侵犯隱私的疑慮。科技的副作用如何透過新訂的法律規章加以管束,民眾又當如何自保?本篇文章會介紹面對AI的濫用或誤用行為,國際上有哪些標準可以依循。

【2024 MAI Talks】From Cloud to Edge – 企業應用AI發展藍圖

CuboAi技術長梁子凌從AI服務公司的角度,談談他帶領CuboAi技術團隊將其服務的基礎架構從雲端轉移到邊緣端所面臨的挑戰,也就他所說的:「從雲端降落凡間的故事。」

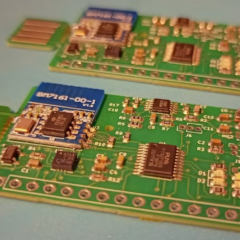

挑戰一美元的TinyML感測器開發板

IoT開發工程師Jon Nordby日前發起一個案子,期望實現只需1美元(以料件成本而言)的TinyML感測器開發板,以此刷新TinyML的低成本紀錄,專案名稱姑且就叫1 dollar TinyML。

Skymizer為邊緣裝置LLM處理打造加速器晶片IP

Skymizer 跨足晶片硬體IP市場,發表EdgeThought (ET2)系列加速器IP,號稱採用革命性的軟硬體協同設計,以該公司的編譯器技術為核心,結合為LLM處理量身打造的運算與記憶體架構,將能為從物聯網(IoT)、手機、PC、汽車到邊緣伺服器等裝置,提供輕鬆執行各種LLM模型的解決方案,包括能支援Meta最新Llama3 8B模型。