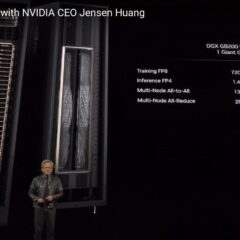

Nvidia GTC 2024 提出的 FP8/FP4 如何加速AI訓練及推論

新一代 GPU Blackwell B200 在硬體端提供了 FP4 計算能力,單片就可達 20 petaFLOPS,二片 B200 組成的 GB200 在訓練性能是前一代 H100 的 4 倍,推論性能更高達 7 倍。若再將 36個 CPU 加上 72 個 GPU 組成「GB200 NVL72」超大型伺服器,則 FP8 訓練能力可高達 720 petaFLOPS, FP4 推論能力更高達1.44 exaFLOPS。而究竟什麼是 FP8 / FP4 呢?本篇文章會簡單幫大家科普一下。

致敬?回敬?繼NVIDIA Chat with RTX後AMD亦推行LLM Studio

LLM/GenAI倚賴雲端資料中心機房裡龐大的運算力,才能即時完成推論結果並回應,一旦網路斷線就無法使用,同時,雲端執行也有洩漏公司機密或個人隱私等風險,鑑於此,不少人開始期待透過本地端或本機端執行LLM。本篇文章,就會介紹AMD推行的LLM Studio,其可下載於本地端進行簡單的聊天問答。

【Edge AI專欄 #15】從MWC 2024看AI手機未來發展

一年一度的世界通訊大會(MWC 2024)於2/26到2/29在西班牙巴塞隆納盛大舉行,此次重點落在了AI上,尤其是不靠連網、本機可獨立運算的生成式應用。為了讓大家更理解AI手機究竟有哪些方案供應商,硬體上究竟有哪些重大突破及軟體上到底能玩什麼應用,本篇文章會為各位一一介紹!

【CIRCUS Pi】使用 Arduino UNO R4 WiFi 遠端控制 LED 燈開關

本文將介紹如何利用Aruino UNO R4 WiFi更新後的遠程控制和監控設備功能,做出能遠端控制的LED燈開關。

推探Google開源、輕量級大型語言模型Gemma

Google基於原有Gemini模型經驗與技術衍生打造Gemma模型,該模型為開放來源程式碼,滿足開源需要的開發者與用戶,有機會進行更多的延伸、衍生或更細深的客製。本篇文章就會對Gemma進行簡單的介紹。