拿大模型程式碼來訓練自用小模型:以AI寫(畫)書法為例

本文會拿Diffusion來學習及創作書法字體,也就是俗稱的:寫書法。雖然Diffusion也能學習依循標準筆順,來逐筆寫出字形。為了從簡單範例出發,本文先讓Diffusion來學習程生成整個字形,而不是逐一生成各筆劃。

【創業小聚】別再寄罐頭信!新創Nureply用AI產生「破冰句」,提升2.4倍開信率

土耳其新創Nureply利用生成式AI推出客製化陌生開發信撰寫軟體,大幅提升2.4倍開信率,並減少額外的時間、人力成本在郵件撰寫的支出。

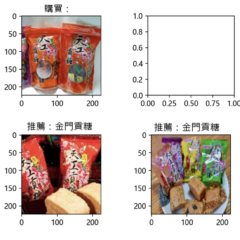

從CLIP應用領會潛藏空間(Latent space)的魅力

本文將從商店櫃檯的產品推薦應用來說明:我們可以拿CLIP的原始程式碼,搭配商家自有產品圖像(Image)和圖像敘述文句(Text),來訓練出企業自用的CLIP小模型,同時也領會其幕後潛藏空間(Latent space)的運作及其效果。

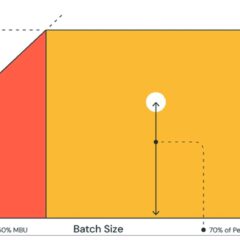

如何利用低位元量化技術進一步提升大模型推論性能

相比運算量的增加,大模型推論速度更容易受到記憶體頻寬的影響,導致算力資源無法得到充分發揮,進而影響性能;低位元量化技術是讓大語言模型(LLM)在部署過程中實現性能需求的最佳方案之一,本文將探討低位元量化技術如何幫助LLM提升性能,以及新版OpenVINO對於低位元量化技術的支援。

如何選擇最適合你的AI推論模型量化方案?

AI推論模型主要透過量化(Quantization)、修剪(Pruning)和聚類(Clustering)三種方式進行最佳化,本文提出一個決策樹,幫助你選擇最適合的量化技術。

活用IPEX和Intel GPU加速大型語言模型訓練效率

以IPEX (Intel-Extension-for-PyTorch)搭配Intel硬體產品,可提供最佳化功能大幅提升運作效能。例如透過PyTorch的