生成式AI的爆發,讓GPU成為近年全球科技產業最受矚目的關鍵資源。從大型語言模型訓練、雲端AI服務,到企業導入生成式AI應用,高階GPU幾乎成為AI基礎設施的代名詞。

然而,當AI從模型開發、效能競賽與示範應用,進一步走向每天需處理數十億次請求、全年無休運轉的商業服務時,產業開始面對另一個更現實的問題:AI系統真正需要的並非單一顆高效能處理器晶片,而是一套能在成本、功耗、延遲、供應穩定性與軟體生態之間取得平衡的異質運算(Heterogeneous Computing)架構。

AI應用部署規模化 算力架構不再只有一種答案

所謂異質運算,就是以不同類型處理器依照各自優勢承擔不同任務:CPU擅長處理複雜控制流程、通用運算、作業系統與應用程式邏輯,因此仍是系統控制與任務調度核心;GPU擁有大量平行運算單元,適合處理矩陣運算、影像處理與模型訓練等可高度平行化的工作負載,成為AI訓練與高彈性推論的重要平台;NPU則是針對神經網路推論設計的專用加速單元,通常強調低功耗、低延遲與SoC整合,適合支援手機、AI PC、車載、工業邊緣裝置中的即時AI功能。

還有一種針對特定AI工作負載、特定資料流與特定部署場景量身打造的AI ASIC(Application-Specific Integrated Circuit,特殊應用積體電路),更強調晶片效能、功耗與成本的最佳化。AI ASIC與CPU、GPU或NPU晶片之間的關係並非直接競爭或相互取代,而是隨著AI應用場景擴大,進入大規模、長時間、對成本敏感的部署階段後,在運算系統中形成更細緻的算力分工,為特定任務提供更高能效與更可控的營運成本。

AI ASIC成為專用化AI系統的新拼圖

AI ASIC的應用範圍並不限於雲端資料中心,而是從大型模型訓練與推論、搜尋與推薦系統,一路延伸到工業視覺、智慧攝影機、機器人、車載感知與邊緣生成式AI等場景。

在雲端資料中心,AI ASIC扮演的角色是支持超大規模AI工作負載,如Google的Tensor Processing Unit(TPU)就是典型代表案例之一。TPU是Google自行開發、用於加速機器學習工作負載的特殊應用積體電路,可用於代理型AI、程式碼生成、大型語言模型、媒體內容生成、語音、視覺服務、推薦引擎與個人化模型等工作負載,支援Google Gemini以及Search、Photos、Maps等AI功能。這類案例顯示,資料中心AI ASIC的價值不只是單顆晶片效能,而是能與雲端平台、模型框架、資料中心網路與軟體堆疊共同最佳化。

AWS Trainium則展現另一種雲端AI ASIC的商品化模式,該晶片被定位為專為生成式AI訓練與推論而建置的AI加速器,Trainium2可透過Amazon EC2 Trn2執行個體與Trn2 UltraServer提供給雲端客戶使用,並支援大型語言模型、多模態模型與擴散轉換器等下一代生成式AI應用。這代表AI ASIC不只可用於雲端業者內部服務,也可以被包裝成雲端算力服務,成為企業使用AI基礎設施時的另一種選項。

圖片來源:AWS

Meta的MTIA則凸顯AI ASIC在社群平台與推薦系統中的價值。Meta表示,MTIA是為其特定AI工作負載提供更高效率架構的長期計畫;2026年Meta進一步揭露MTIA 300、400、450與500等後續晶片,其中MTIA 300已用於排名與推薦訓練,後續版本則將支援生成式AI推論生產環境。對Meta這類平台而言,內容排序、推薦、廣告與生成式AI服務每天都以極高頻率運行,只要能在效率、記憶體頻寬或系統利用率上改善,就可能在資料中心營運成本上產生顯著差異。

Meta開發的AI晶片MTIA (圖片來源:Meta)

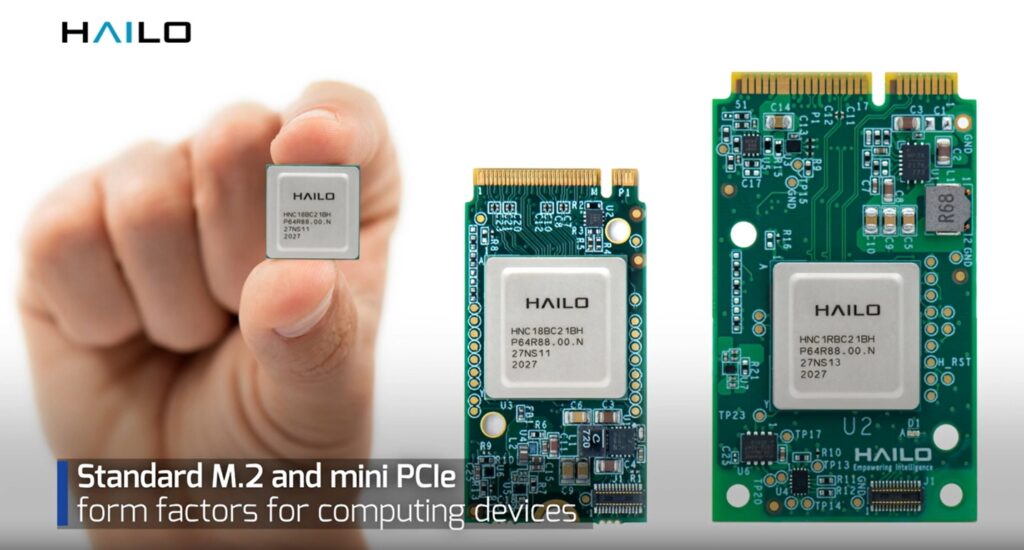

除了超大規模資料中心,AI ASIC也正在邊緣AI系統中扮演愈來愈重要的角色。與雲端ASIC追求大規模叢集效率不同,邊緣AI ASIC更重視低功耗、小尺寸、低延遲與本地即時處理能力。例如Hailo-8邊緣AI處理器主打最高26 TOPS效能,並以M.2等模組形式整合到邊緣裝置,用於在本地端執行深度學習推論,可在智慧攝影機、工業設備、零售終端或嵌入式系統中進行即時辨識與判斷。

Hailo-8邊緣AI處理器(圖片來源)

Axelera AI的Metis AIPU則是另一個邊緣AI ASIC案例,根據這家總部位於荷蘭的IC設計公司介紹,單一Metis AI處理單元可提供最高214 TOPS INT8效能與15 TOPS/W能源效率,並可透過M.2模組或PCIe卡形式導入邊緣系統。台灣工業電腦業者艾訊也曾宣布其邊緣AI系統AIM101可整合Axelera Metis M.2 AI推論加速卡,用於即時電腦視覺與工業自動化應用。這類合作說明,邊緣AI ASIC並不只是晶片公司單獨推動,而是需要與工業電腦、嵌入式平台、軟體開發工具與產業應用場景共同落地。

在視覺AI與智慧攝影機領域,Ambarella則長期以影像處理與AI視覺SoC切入邊緣市場。其CVflow架構可將以Caffe、TensorFlow、PyTorch等工具訓練的卷積神經網路映射到Ambarella處理器上執行;最新CV7 Edge AI 8K Vision SoC則強調高解析度影像處理、多感測器感知與低功耗AI效能,應用方向涵蓋智慧監控、車載感知、機器視覺與消費性影像裝置。

Ambarella的AI晶片特別強調符合車用功能安全性ISO26262標準認證。(圖片來源:Ambarella)

Ambarella的案例顯示,AI ASIC在邊緣端扮演的角色也不只是單純的矩陣運算加速器,而是與影像訊號處理、視訊編解碼、多感測器輸入與AI推論整合在同一系統中。

AI ASIC正在改變半導體供應鏈互動模式

從雲端資料中心到邊緣AI系統,AI ASIC在不同場景中扮演的角色並不相同。在雲端,它服務的是大型模型、推薦系統、搜尋與生成式AI等高吞吐工作負載,核心價值在於降低長期營運成本、提升能源效率,並強化平台業者對算力架構的自主性;在邊緣,它則著眼即時感知、本地推論、低延遲反應與資料隱私等需求,讓AI更靠近資料產生現場。

AI ASIC的崛起也在改變半導體供應鏈。過去晶片廠多半定義標準產品,再由系統廠、雲端客戶或終端設備業者採購;但隨著AI應用部署的規模化與多樣化, 晶片開發變得更貼近應用場景。在雲端資料中心,大型業者往往更早介入晶片規格定義,並與ASIC設計服務商、IP供應商、晶圓代工、先進封裝、HBM記憶體、載板、伺服器、電源與散熱業者共同協作,針對大型模型推論、推薦系統、搜尋與生成式AI服務最佳化整體算力架構。

在邊緣端,隨著應用部署規模逐漸成長,工業電腦、智慧攝影機、機器人、車載與嵌入式系統業者,也開始需要更貼近場域需求的AI ASIC或AI加速晶片,以支援低功耗、低延遲、本地推論與多感測器融合等應用。這使AI ASIC不再只是資料中心議題,而是從雲端到邊緣,推動半導體供應鏈在AI時代走向更高程度客製化與系統協作的關鍵力量。

- 從雲端到邊緣 AI ASIC推動算力架構「專用化」 - 2026/05/15

- AI加速滲透全球:亞洲扮演成長主引擎 台灣進入Top 20 - 2026/05/11

- 從雲端走向終端:Edge AI成為產業數位轉型新戰場 - 2026/05/06

訂閱MakerPRO知識充電報

與40000位開發者一同掌握科技創新的技術資訊!