如何利用低位元量化技術進一步提升大模型推論性能

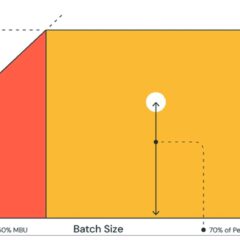

相比運算量的增加,大模型推論速度更容易受到記憶體頻寬的影響,導致算力資源無法得到充分發揮,進而影響性能;低位元量化技術是讓大語言模型(LLM)在部署過程中實現性能需求的最佳方案之一,本文將探討低位元量化技術如何幫助LLM提升性能,以及新版OpenVINO對於低位元量化技術的支援。

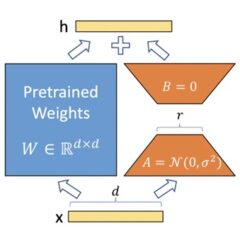

利用Intel平台提升LLM微調與訓練效率:ResNet50+LoRA範例

本文將說明如何善用英特爾(Intel)所研發的新產品和相關技術,來提升AI模型的訓練效率,以便提供更優質的推論功能。為了循序漸進介紹上述的新產品及其相關的使用技術,本文先從大家熟悉ResNet50圖像分類模型做為起步範例,並搭配LoRA來進行外掛訓練,以便從這簡單範例中充分理解如何活用上述的創新產品及相關技術。