樹莓派也能「養龍蝦」!

近期掀起的養龍蝦(OpenClaw)風潮不僅炒熱了Mac mini的銷售,許多單板電腦、AI個人電腦也緊隨其後,而創客圈最普遍使用的單板電腦樹莓派也確定跟風加入。

邊緣智慧輕鬆駕馭:高通帶領開發者掌握裝置上Gen AI應用部署關鍵

為了讓開發者親自體驗高通的工具鏈資源能為Edge AI應用部署任務提供的助力,以及Snapdragon X系列AI PC的效能表現,該公司於12月下旬舉辦了一場「邊緣智慧由你掌握:裝置上Gen AI應用開發與部署工作坊」,聚焦生成式AI應用在裝置端落地的實務…

Nordic Semiconductor為數十億物聯網設備簡化Edge AI應用

憑藉領先的超低功耗解決方案,Nordic加速了整合邊緣人工智慧(Edge AI)的新一代設備的誕生,將能源效率與惠及開發者的易用性完美結合。

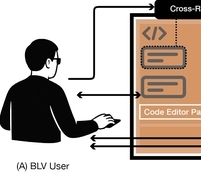

AI工具讓視障者也能順利完成3D建模!

3D建模目前以OpenSCAD這套軟體最具代表性,從軟體名稱上也可瞭解這是一套開放、免費的軟體,因而被人廣泛使用,特別是在教育領域。對一般人而言使用OpenSCAD並無大礙,但對視障者而言則有困難…

NVIDIA與Synopsys攜手推動跨產業設計與工程革新

NVIDIA與Synopsys宣布擴大策略合作,以推動跨產業的設計與工程革新。著眼半導體產業到航太、汽車、工業等眾多領域,研發團隊皆面臨嚴峻的工程挑戰,包括日益複雜的工作流程、不斷攀升的開發成本及上市時間壓力等。

英飛凌IPOSIM平台新增基於SPICE的模型生成工具

英飛凌宣佈其功率元件線上模擬平台(IPOSIM),整合了一款基於SPICE的模型生成工具,可將外部電路和閘極驅動器選型納入系統級模擬。該工具透過充分考慮元件的非線性半導體物理特性,提供更加精確的靜態、動態及熱性能結果,實現了在廣泛工況下的深度元件對比,並加快了設計決策速度。