【2024 MAI Talks】AIPC帶給開發者的即戰力

Intel平台研發協理王宗業分享的「AIPC帶給開發者的即戰力」。從幾個方面介紹了AIPC(Artificial Intelligence Personal Computer)對開發者的重要性和實用性,並展示了Intel在AI技術方面的領先地位和未來發展方向。

【活動報導】AI PC搭OpenVINO 在邊緣輕鬆部署LLM!

為了讓開發者更充分了解如何在自己的AI PC上發揮Intel最新版本OpenVINO開發平台的效能以實現更多創新應用,MakerPRO與Intel共同舉辦了以「探索AI PC新時代,學習在邊緣裝置輕鬆運作LLM」為題的第四場OpenVINO DevCon線上講座。

【2024 MAI Talks】陳縕儂:打造台版LLM的理由與挑戰

在台大資工系陳縕儂副教授主講的「打造台版LLM的理由與挑戰」演講中,主要討論了建立台灣版大型語言模型(LLM)的必要性及挑戰,並分享了她和她的學生在這方面的努力和成果。

【Edge AI專欄】 開發者如何選擇 Edge AI 開發方案

「Edge AI」到底是什麼,可能問十個專家會得到十一種答案,但這些都沒有對錯,只是大家都以自己的立場回答問題而已。本篇文章,會就Edge AI方案挑選幾項重點項目進行介紹。

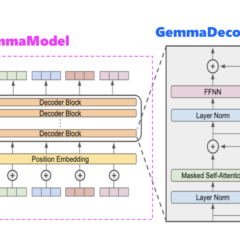

為什麼Gemma採取Decoder-Only Transformer架構呢?

本篇文章會說明Gemma為何會採取Decoder-Only Transformer架構,並針對Decoder-Only Transformer架構進行介紹。