本文由Silicon Labs供稿

在這篇文章中,我們將展示如何使用芯科科技(Silicon Labs)的xG24無線SoC開發套件與Arduino Nano Matter開發板平台,結合TensorFlow Lite Micro打造一個能夠辨識手勢的「魔法棒」裝置。這個專案展示了Matter協定與人工智慧和機器學習(AI/ML)在邊緣設備上的協同運作能力。

專案概述

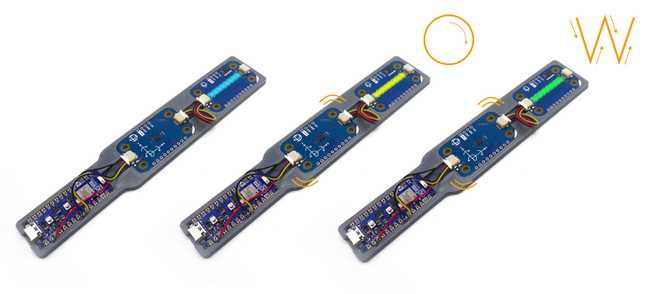

ML魔法棒結合了Modulino Movement、Modulino Pixels和AI/ML硬體加速器,使用加速度計來偵測簡單的手繪手勢——例如「W」或「O」形狀,並透過機器學習模型進行分類。這些手勢透過TensorFlow Lite模型在設備上即時識別。當偵測到特定手勢時,裝置會透過Matter協定控制智慧家庭設備,而無需雲端處理,例如開關燈光或觸發其他動作。

這個項目充分展現了開發者如何結合以下技術:

- AI/ML:實現智慧的本地決策。

- xG24:提供低功耗、高性能和機器學習加速。

- Arduino Modulinos:模組化硬體設計。

這些技術的結合,使智慧家庭的使用者得以獲得更迅速響應、安全可靠且具備可擴展性的體驗——無需依賴雲端。

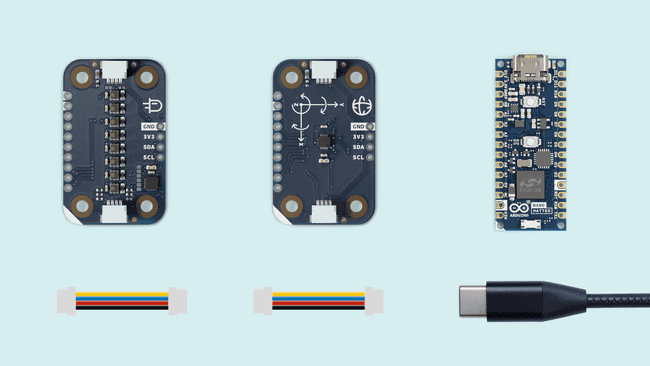

所需硬體

- Arduino Nano Matter板或Silicon Labs xG24 Explorer Kit

- 加速度計模組(例如 ADXL345)

- USB-C 線

- 電腦(安裝 Arduino IDE)

軟體與工具

- Arduino IDE

- Silicon Labs Arduino Core

- TensorFlow Lite Micro

- Matter Library

- Simplicity Studio(選用)

嵌入式機器學習演示的主要步驟

- 安裝必要的函式庫與工具套件

在Arduino IDE中安裝Silicon Labs Arduino Core,並匯入TensorFlow Lite Micro與Matter函式庫。 - 連接加速度計模組

將加速度計模組透過 I2C 或 SPI 接口連接至開發板。 - 訓練機器學習模型

使用TensorFlow收集手勢資料並訓練模型,例如「向左揮」、「向右揮」、「畫圈」等。 - 部署模型至裝置

將模型轉換為TensorFlow Lite Micro格式並嵌入至Arduino程式碼中。 - 整合Matter控制邏輯

當模型辨識出特定手勢時,透過Matter協定觸發智慧家庭設備的動作。 - 測試與調整

上傳程式碼至開發板,測試手勢辨識與Matter控制是否正常運作。

展示效果

當使用者揮動魔法棒時,裝置能即時辨識手勢並控制燈光或其他 Matter 支援設備。這展示了 AI/ML 與無線協定在邊緣設備上的協同運作能力。

親自試試看

準備好揮動「W」或「O」手勢了嗎?完整的教學請參考Arduino官方網站的內容,我們非常期待看到你如何以本範例進行擴展——無論是用於智慧家庭控制、輔助工具,還是為嵌入式開發增添一點魔法。

(原文連結:Community: ML Magic Wand with Arduino Nano Matter and Silicon Labs xG24)

- AI賦能邊緣新局:研華嵌入式設計論壇描繪產業智慧化新路徑 - 2026/04/30

- 思科新推通用量子交換器 引領量子網路新里程碑 - 2026/04/29

- 從資料到部署一站加速:研華攜手Edge Impulse降低Edge AI開發門檻 - 2026/04/27

訂閱MakerPRO知識充電報

與40000位開發者一同掌握科技創新的技術資訊!