隨著生成式AI加速走向實體世界,機器人產業也面臨全新的技術轉折,走向結合多模態AI、語意理解與實體控制的新階段。而對關注機器人相關應用的開發者來說,真正需要的不只是更強大的模型,而是一條能串連從感知、推論、控制到模擬與部署的完整VLA (Vision-Language-Action)技術路徑。

在3月17日登場、由研華科技(Advantech)主辦的「NVIDIA® Jetson Thorᵀᴹ 平台機器人開發者實戰營」線上研討會,就由來自研華與機器人開發領域的多位專家開講,從機器人產業趨勢、VLA架構到實作工具等不同層面,詳細介紹如何結合NVIDIA Isaac框架、Jetson Thor平台與研華的Robotic Suite機器人開發套件,協助開發者克服資料不足與模擬、實體落差等挑戰,以及在實現AMR、機械手臂與人形機器人等場景的應用,並透過研華ASR-A701開發套件展示大型Transformer模型在Edge端的推論、感測整合與部署流程。

VLA扮演新世代機器人開發關鍵

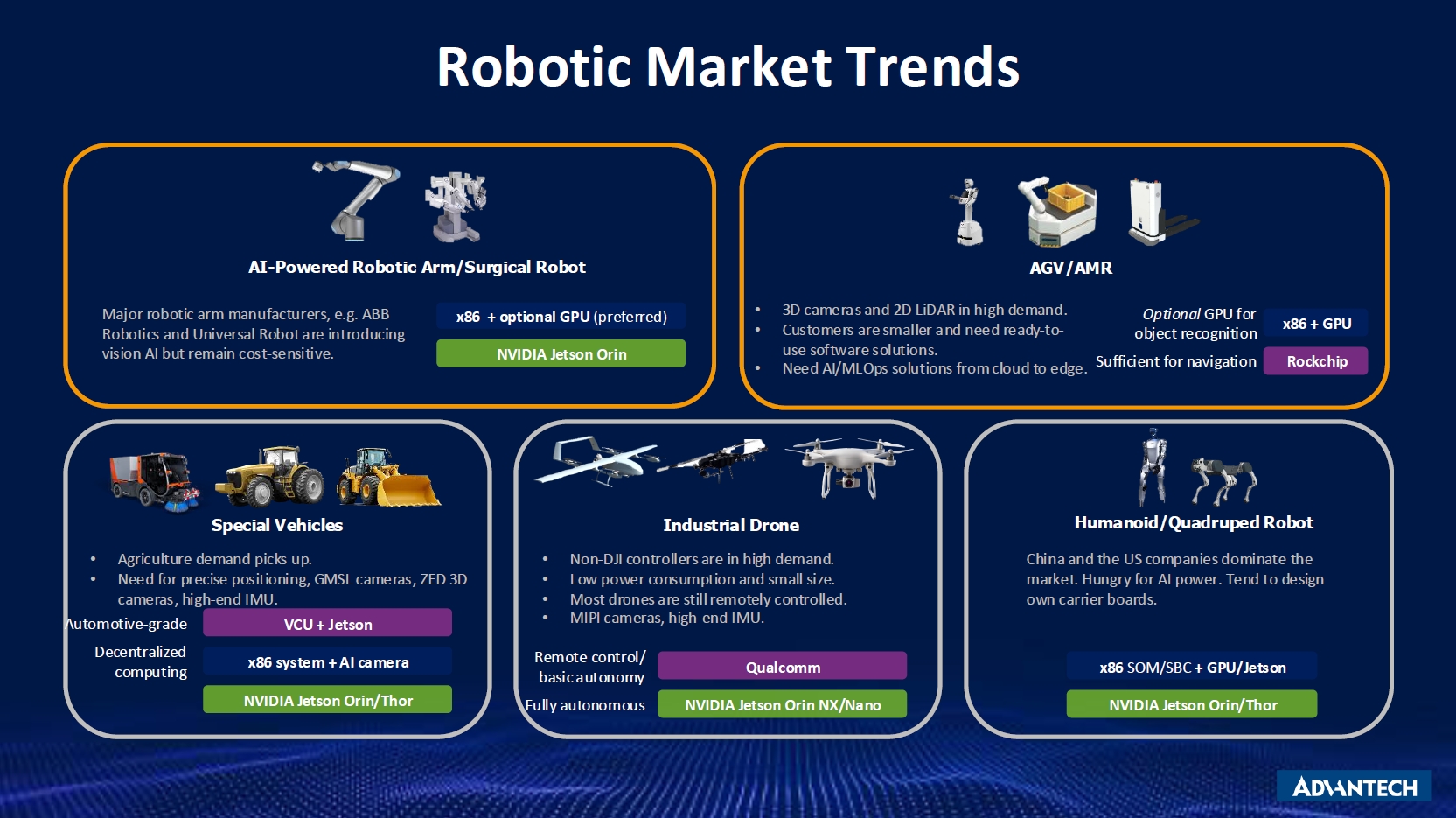

研華機器人事業部市場開發經理劉宜鑫在實戰營開場演說中指出,許多業者都在積極評估如何切入機器人市場,但真正的挑戰往往從選型就開始。根據研華的觀察,客戶首先必須依任務情境挑選感測器、運算平台與軟體架構,之後還得面對研發時程、技術迭代,以及上線後的通訊、充電、AI 更新與資安維運等問題。

他也特別強調,不同應用對算力需求差異極大,因此:「不是算力越高越好,而是要適當」;從機械手臂、AGV/AMR到無人機與戶外自主車,市場都正朝向更高彈性、更多AI任務,並逐步朝VLA架構演進。(演講影片)

接著飆機器人(PlayRobot)研發組長陳邵亨則從技術演進脈絡切入,說明機器人控制如何從傳統流程控制、走向代理式控制,再進一步發展到VLA。他指出,過去工廠場域講求的是固定流程與確定性,因此多半仰賴按鈕或介面觸發,在加入大型語言模型後,機器人可透過自然語言呼叫工具與既有控制模組,形成較靈活的代理式架構,而目前多數落地方案也仍停留在這一層。

陳邵亨進一步指出,VLA的關鍵差異在於:「直接把命令、影像跟動作一併丟給模型,讓輸出不再只是文字或判斷結果,而是可直接對應到機器人各關節的動作數值,讓AI真正跨入實體世界。」以飆機器人正在開發的自主巡檢互動機器人為例,上半身結合MCP任務管理、VLA 環境感知與手臂控制,下半身則保留較成熟的底盤導航技術,形成兼顧穩定與智慧化的半身形架構。

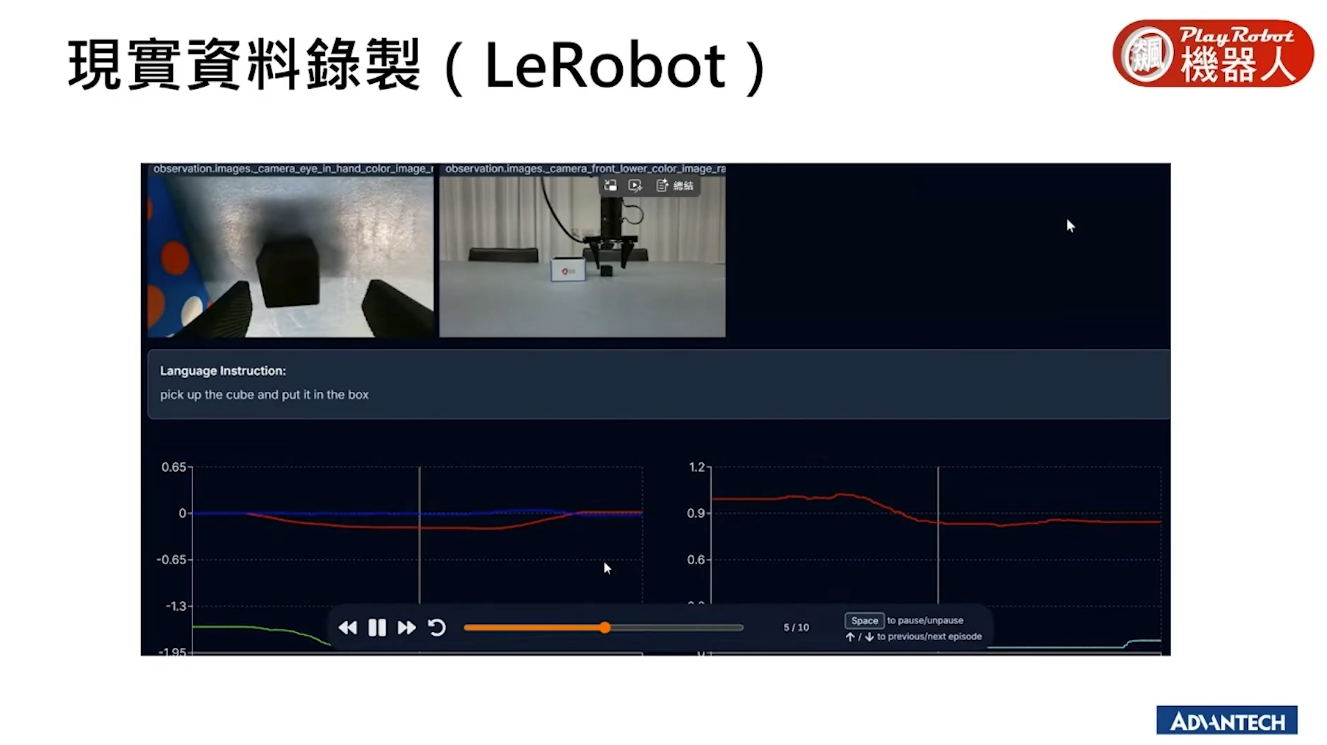

至於在開發實務上的痛點,他坦言,VLA 真正困難的不是概念,而是資料與訓練流程。由於真實資料不足,團隊必須結合模擬環境補足訓練樣本,甚至以生成式工具擴充光照、材質與角度差異,提升模型泛化能力。以手臂夾取方塊的案例來看,約十次真實操作再搭配百筆左右虛擬資料,仍需五到六小時訓練才能得到可用結果,若環境變化不足、參數設定不理想,仍可能出現漏抓、放不準等問題,這時又得回頭補真實資料、擴模擬資料、重新調整訓練,才能逐步縮小從模擬到部署之間的落差。(演講影片)

為不同應用選擇算力最恰當的機器人平台

當VLA、3D感測與多模態任務開始進入機器人系統,對開發者來說該怎麼選擇平台、又該如何搭配感測器?除了在開場時提及的「選擇最恰當算力」,劉宜鑫表示,研華觀察到許多客戶的團隊原本是在Intel或其他既有環境中開發,當應用逐步加上AI任務、3D相機或高頻寬影像輸入後,往往就面臨平台移轉、攝影機相容性與工具鏈不連續等問題。

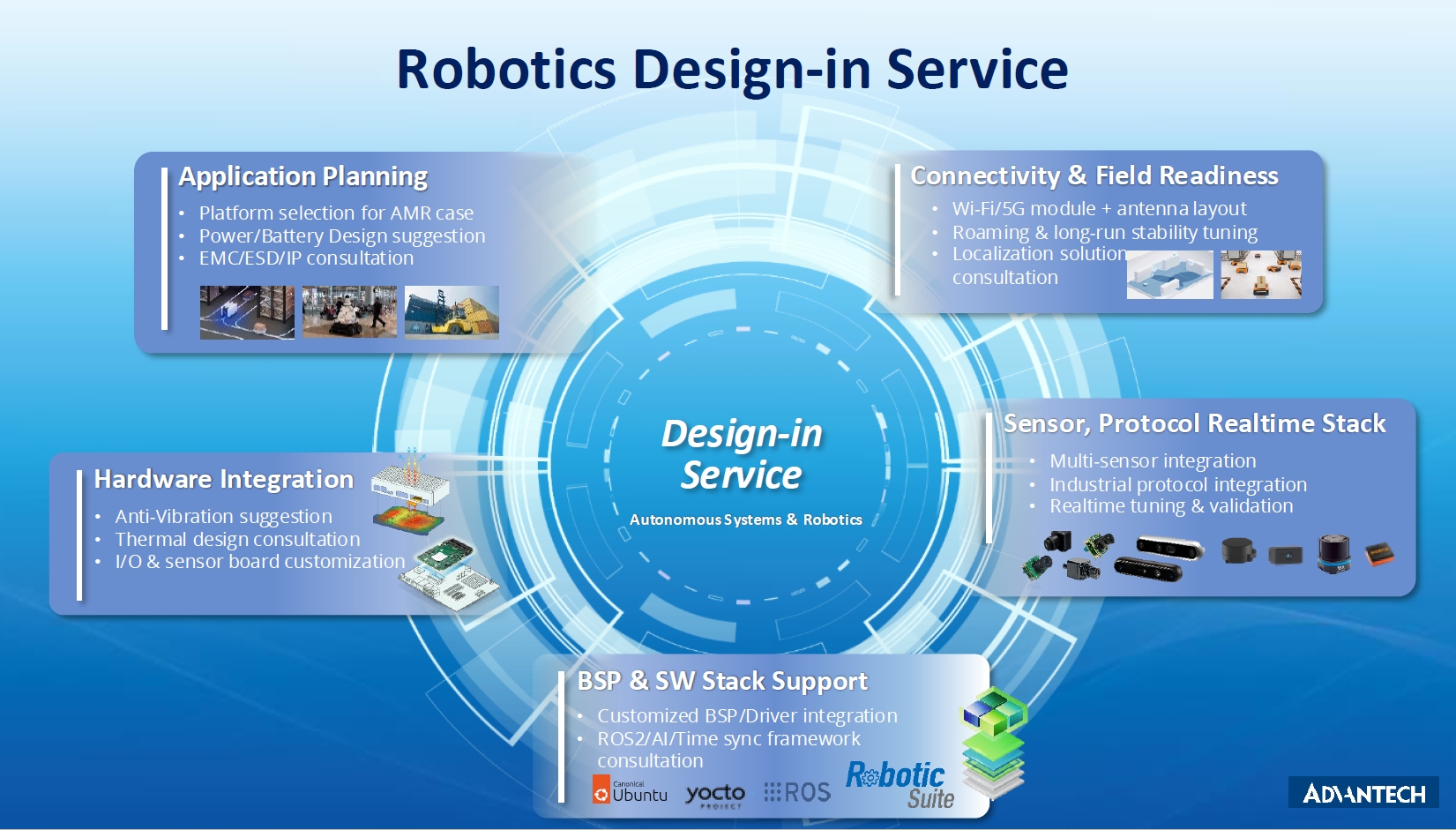

因此他指出,研華近三年前成立自主系統與機器人事業部後,並非把通用型工業電腦重新包裝成機器人控制器,而是依AI機械手臂、AGV/AMR、特種車輛、人形機器人等不同情境,規畫出單板、系統與專用機等不同形態的產品線,並搭配相機、IMU、LiDAR、無線通訊與Robotic Suite開發工具,提供較完整的一站式方案。

劉宜鑫也進一步說明,所謂「專用機」的價值,不在單一CPU或GPU 規格,而在於它是否真正回應機器人場域的需求。以研華的機器人平台為例,除了可在相同板型或機構尺寸下切換不同等級的處理器與模組,也把時間同步、GPS 對時、寬電壓輸入、抗震、靜電保護,以及足夠的相機、USB、乙太網路與感測器 I/O 都一併納入設計;對需要多顆2D、3D 攝影機、LiDAR 與 IMU 的高階應用而言,這些條件往往比單看算力更關鍵。

研華也依成本與算力需求,提供從Rockchip、Qualcomm、Intel,到 Jetson Orin NX、Jetson AGX Orin 與 Jetson AGX Thor的完整產品藍圖,讓開發者可依情境複雜度與AI任務密度選擇平台。劉宜鑫並以搭載兩顆3D相機的ASR-A701開發套件為例,說明研華如何把主機、感測器與周邊先行組合成可快速展開產品概念驗證(POC)的起點;至於更高階的人形機器人或複雜AMR場景,則可進一步往Jetson AGX Orin 或 Thor等級的專用平台延伸。(演講影片)

將繁瑣的開發流程收斂為可快速起跑的工具鏈

釐清了如何選擇最恰當的軟硬體方案之後,研華軟體系統架構協理許丞佑指出,機器人開發專案真正耗時的通常不是模型本身,而是前段繁瑣的整合流程,包括Linux與JetPack版本確認、BSP與週邊驅動安裝、ROS/ROS 2環境建置,以及2D、3D相機、LiDAR、IMU與各類開發工具的串接。

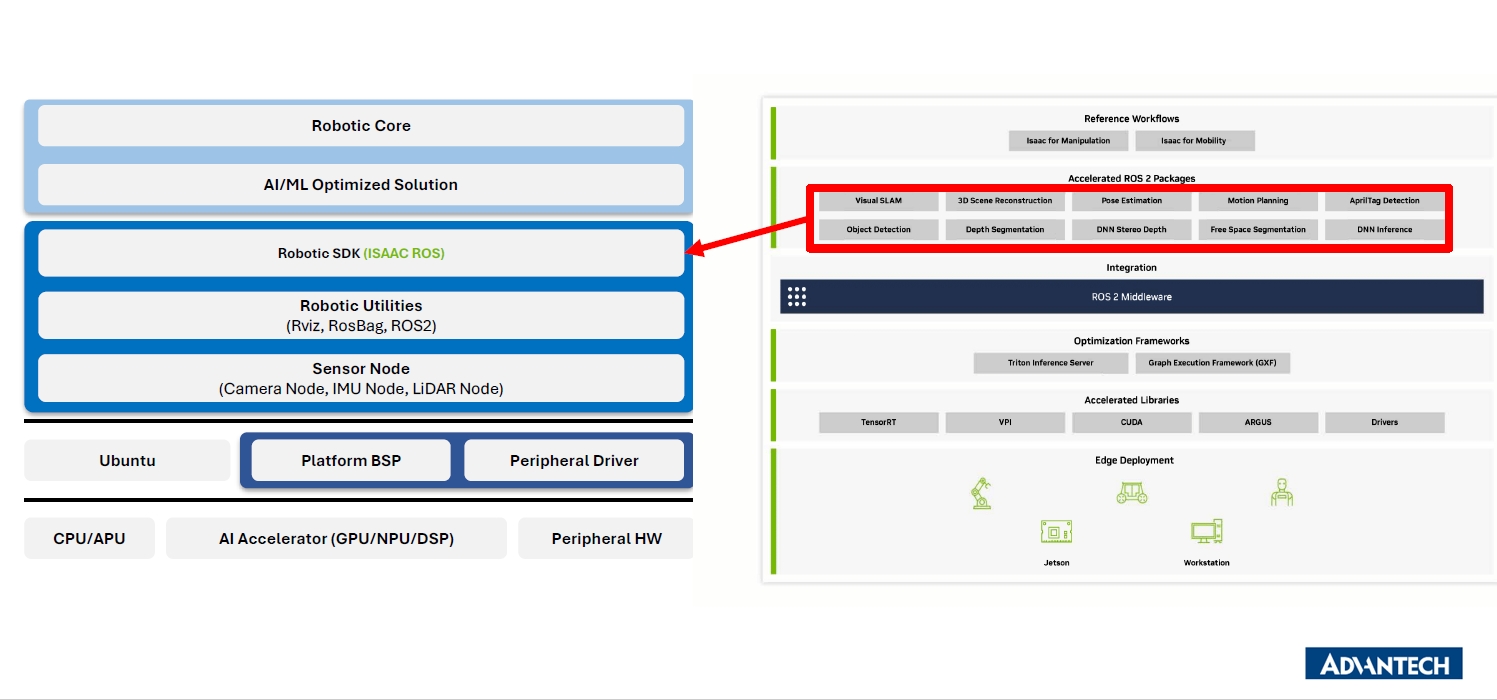

Robotic Suite的定位就是一套「從硬體到開發軟體都先驗證好」的整合方案,目的不是要使用者再多學一套封閉系統,而是把常用的開發元件先整理成可直接起跑的環境。許丞佑說明,這套架構往下涵蓋Ubuntu、Platform BSP、Peripheral Driver,以及Camera、IMU、LiDAR等感測器節點,往上則整合Robotic Utilities、ROS2、Isaac ROS 與 AI/ML 最佳化模組,讓機器人從感測、地圖建立、定位、導航、規劃到控制的常見功能,可以在較完整的基礎上展開二次開發。

許丞佑也以行動型的送餐機器人為例,指出這類方案開發首先要完成環境重建與地圖建立,接著透過定位確認機器人所在位置,再進入導航、路徑規劃與避障。對應到研華與NVIDIA整合的工具鏈,這些工作可結合Isaac ROS Visual SLAM、NVBlox、Map Localization、Visual Global Localization、AprilTag 與 Nav2/Autoware 等模組來完成;其中 NVBlox 能把相機與深度資訊轉成 3D 場景理解,協助系統判斷哪些區域可安全通行、哪些區域需要重新規劃路徑,進一步支撐自動導航與動態避障。

他指出,當機器人不只是移動到定點,而是要能理解「去拿什麼、放到哪裡、如何執行動作」時,系統架構就會從過去的文字或影像理解,往VLA方向推進。在訓練上可使用研華AIR-420搭配NVIDIA RTX PRO 6000平台,透過Isaac Sim、Isaac Lab、Cosmos 與 imitation learning建立流程累積虛擬資料,再把成果部署到搭載Jetson Thor的研華ASR-702平台;或是由開發者實際帶動機械手臂完成抓取、旋轉與放置等動作來進行訓練。他指出,未來機器人比拚的已不只是制式化重複動作,而是面對變化情境時仍能維持任務彈性的能力;而這也正是Robotic Suite與NVIDIA生態系整合後,希望協助開發者更快跨過的那道門檻。(演講影片)

Robotic Suite:快速實現VLA落地部署

研華解決方案資深工程師林新澔則進一步介紹Robotic Suite的安裝與使用細節,並將機器人專案實作拆解為四個階段:感測、洞察、規劃與執行。他指出,Robotic Suite要解決的核心問題,是縮短開發者從硬體到應用之間的起步時間;以安裝流程為例,使用者只需依指令選擇所需套件,約一小時即可完成環境建置,安裝內容涵蓋Isaac ROS、ROS 基本功能範例與 Autoware開發環境,且部分模組以container方式提供,讓環境更穩定一致。

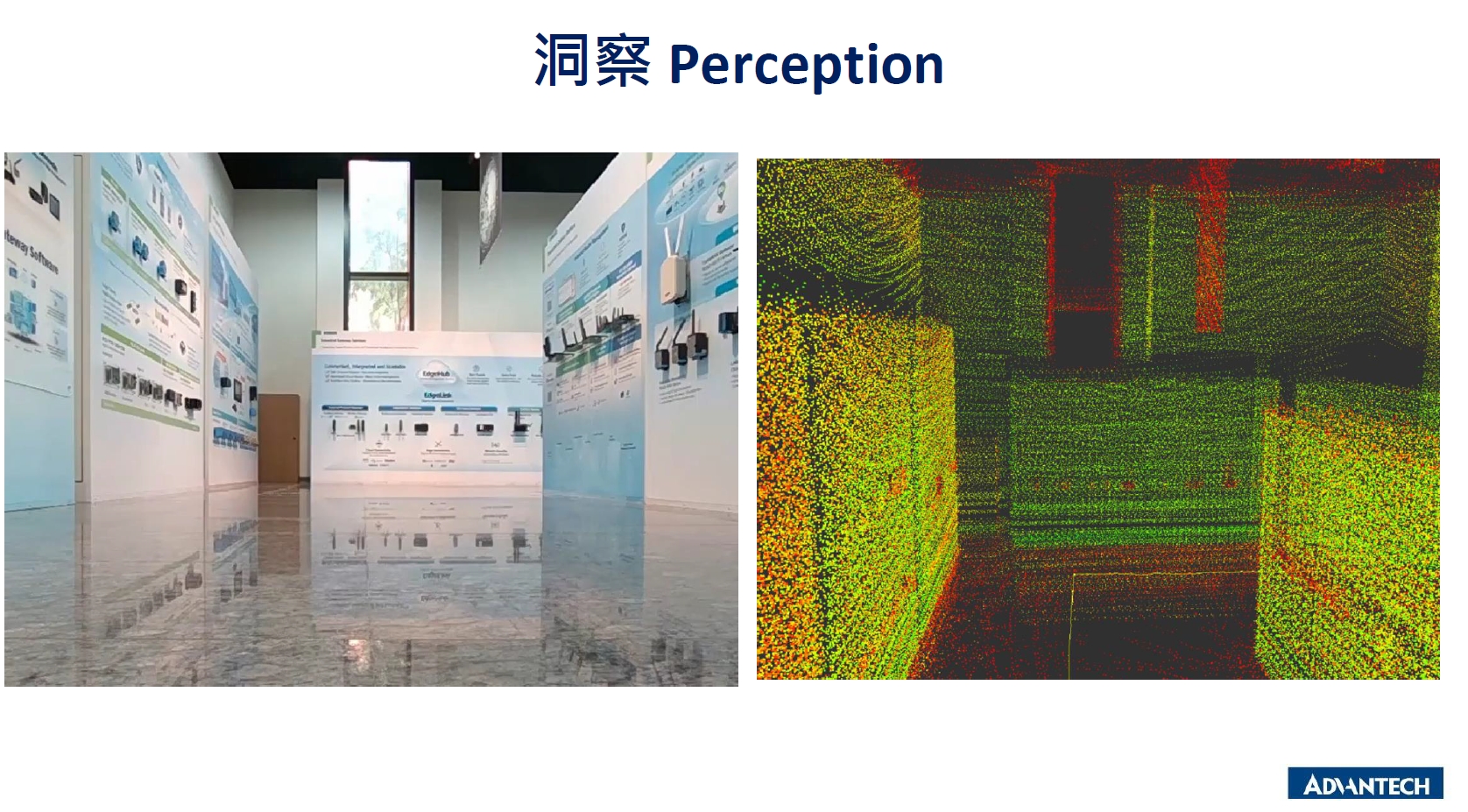

在感測階段,林新澔強調,機器人若尚未接收任何感測器資料,其實就像是「看不見、也不知道自己在哪裡,」因此Robotic Suite會先整理出已驗證可用的 2D/3D 相機、2D/3D LiDAR、IMU、GPS、Wi-Fi與5G模組,並搭配文件、驅動與 ROS 範例,協助開發者更快把資料串進系統。到了洞察階段,則透過 YOLOv8、NVBlox、2D SLAM 與 3D SLAM 等工具,讓原本只是影像、深度或點雲的資料,進一步轉成可理解的物件辨識、可行走區域與空間地圖。

再往下的規劃階段,林新澔以Nav2 與 Autoware為例,說明系統如何依任務目標、自身定位與即時障礙物資訊,自動調整移動路徑;即使地圖中原本沒有的障礙物臨時出現,演算法也能重新規劃路徑。最後進入執行階段時,他展示實際小車如何依 LiDAR 掃描結果停下、轉向或繞行,同時也提到Robotic Suite已支援OPC UA、Modbus與GPIO等常見控制方式,讓ROS不只停留在導航與感知層,也能直接向外部設備下達控制指令。並不只是提供幾個示範案例,Robotic Suite是希望把感測到動作的整條流程,整理成開發者能快速套用與延伸的基礎框架。(演講影片)

從工具選型到安全邊界:機器人落地的務實課題

在這場實戰營最後,陳紹亨與林新澔透過分別代表開發者與解決方案供應商的交流對話,將討論焦點延伸到實際部署機器人應用時最常遇到的幾個關鍵問題,包括資安、安裝架構、算力選型,以及VLA與傳統演算法之間的分工。針對陳紹亨提出的資安議題,林新澔表示,目前Robotic Suite尚未內建專屬的資安工具,但ROS生態系中已有SROS (Secure ROS) 等相關機制,若客戶有需求,後續也可納入更新方向。談到安裝方式,他則解釋,Robotic Suite採 host 與 container 混合架構:像ROS套件等核心環境裝在host端,避免影響底盤控制與導航即時性;至於demo與較複雜的開發環境,則以 container 打包,以縮短部署時間並降低相依套件衝突。依他的說法,像Autoware 這類安裝繁複的工具,透過container可把原本動輒一天的建置時間壓縮到一小時內。

在算力評估方面,林新澔則指出,2D LiDAR、3D LiDAR、2D/3D 相機的資料量與運算需求差異很大,因此平台選型仍須回到實際感測器配置與應用情境判斷。例如若以3D LiDAR做PoC,通常至少會建議從 Jetson AGX Orin 64GB 等級起步,再視是否疊加 VLA 或更高階模型進一步升級。陳邵亨則總結開發經驗補充指出,現階段VLA並不適合全面取代導航、避障或高速反應控制,像底盤控制、PID、即時煞停或突發道路意外處理,仍應優先交給成熟、可預期的傳統演算法或既有控制架構;VLA與代理式系統更適合放在較高層的任務理解、互動與工具調度。

總結

整體而言,現階段機器人落地的關鍵,不是用單一新技術取代一切,而是在安全性、穩定性與智慧化之間,找到最合適的混合式架構;而這也正是研華此次研討會所凸顯的核心價值:從運算平台、感測器整合到Robotic Suite 開發環境的完整機器人解決方案,研華期望協助開發者把複雜的開發流程收斂成更可操作、可驗證,也更接近商業落地的一條實戰路徑,加快各種機器人應用落地,也能因應後續營運對穩定性、維護性與持續升級的需求。

》收看完整影片:

- 從VLA到落地部署:拆解新世代機器人開發關鍵路徑 - 2026/03/24

- 【Podcast】分散式代理時代:2026 Edge AI 技術全解析 - 2026/03/24

- 英飛凌攜手NVIDIA以數位孿生技術加速部署安全可靠的機器人 - 2026/03/24

訂閱MakerPRO知識充電報

與40000位開發者一同掌握科技創新的技術資訊!