就如同多數新科技問世後,在一陣新奇感後,生成式人工智慧(Gen AI、AIGC)也進入「市場在哪裏?」的現實挑戰,很多人提出AIGC熱潮已消退的說法,但落地的亮點應用其實也有不少,本文將探討AIGC當前的發展亮點與挑戰為何。

AIGC當前發展亮點

1. 增加能力:AI作為輔助工具

AIGC目前的應用更集中於“增強”而非完全的“自動化”。與完全取代人類工人相比,AI越來越多地被用於增強人類的能力,在編碼(如GitHub Copilot)、寫作和研究等領域充當輔助工具。這種方法降低了員工的抵制,並幫助在不完全依賴自動化的情況下提供增量價值。

認識GitHub Copilot(Source)

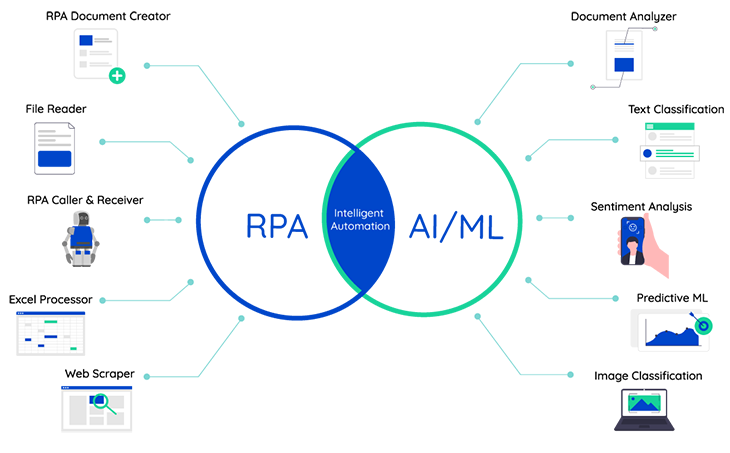

2. 結合RPA:與現有業務流程的整合

要使生成式AI繁榮,它必須無縫整合到現有的企業系統中。目前應用的一大重點在於將AI整合到傳統的業務流程中,例如客服(通過精細調整的生成式模型的聊天機器人)、個性化營銷以及自動化報告生成。將AI與機器人流程自動化(RPA)結合,可以幫助簡化這些流程,為企業提供明確的價值。(延伸閱讀:【自動化工作流程】n8n整合AI之常見應用及創建流程)

RPA與AI的協作藍圖(Source)

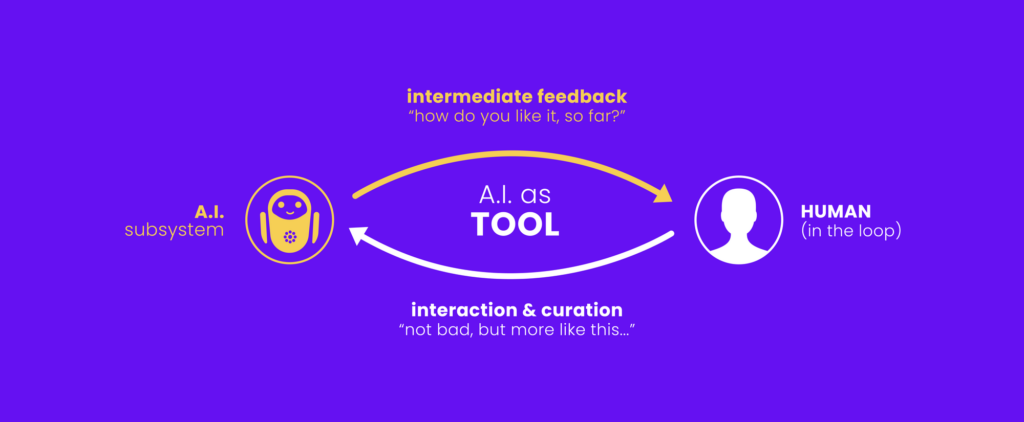

3. 人類參與的系統(Human-in-the-Loop, HITL)

為了減少可靠性問題,“人類參與”系統變得越來越受歡迎。HITL就是一種將人類參與融入人工智慧(AI)系統中的方法,讓人類在AI系統的訓練、運行或結果驗證過程中進行監督和干預。在這些系統中,人類專家監督和微調AI生成的輸出。這種合作方式增強了信任並確保質量,使得在醫療和金融等敏感領域中部署AI變得更可行。

Human-In-The-Loop示意圖(Source)

AIGC面對的挑戰

AIGC的熱潮似乎正在消退,這背後涉及多種因素,如擴展性挑戰、成本效益、監管問題以及實際整合的困難。以下是對這一現象的解釋:

1. 高昂的計算成本

生成式AI模型,特別是像GPT-4這樣的大型語言模型(LLM),需要龐大的計算資源來訓練,且在部署過程中需消耗更多資源。維持這些服務所需的高性能GPU和持續的推理計算成本非常昂貴,這限制了許多企業能夠有效地實施和利用這些工具。

2. 數據和能源消耗

訓練這些模型需要大量的數據集和能源,這引發了對AI技術可持續性和可擴展性的質疑。對於AI技術的環境影響的批評越來越多。

3. 商業應用有限

儘管生成式AI展現了令人印象深刻的創造能力,但在如何將其應用於實際、創收的場景中仍存在限制。許多企業難以將AIGC的創造潛力轉化為具有實際價值的解決方案,這使得其應用更多地局限於藝術或文本生成等新奇用途。

4. 質量和可靠性問題

雖然技術有進展,生成式AI仍面臨質量問題,例如產生錯誤或不合邏輯的內容(即“幻覺”)。許多企業難以在關鍵業務中信任這樣的系統。缺乏精確性和難以達到高準確率,成為大規模應用的一個障礙。

5. 監管和倫理考量

關於數據隱私、版權侵權和AI倫理使用的監管審查越來越多。許多國家正在提出或制定法律來規範生成式AI的使用。對於誤導性信息、數據安全和知識產權的擔憂也導致公司採取更加謹慎的態度。

AIGC技術發展方向

1. 專業化AI模型

接下來的趨勢可能是開發更多專業化、針對特定領域的AI模型,而不是依賴於單一大型的通用模型。行業專用的AI模型,基於特定行業的數據進行訓練,可以提供更實際和有效的解決方案。這種方法有助於降低成本並提高可靠性。

2. 混合AI解決方案

將生成式AI與其他AI技術結合,如強化學習或符號AI,有助於克服當前的局限性。混合解決方案可以創建更具推理能力的系統,優化決策過程,並減少目前模型中的幻覺問題。

3. 高效與可持續AI

目前正在將重點轉向讓AI變得更高效。通過模型剪枝、蒸餾、量化等技術來減少計算需求的同時保持性能。開發更小、更高效的模型(例如TinyML)和在邊緣端執行的AI技術進展,將幫助AI變得更加普及並減少能源消耗。

4. AI監管與負責任的AI發展

隨著監管的增多,我們將看到更多對倫理和負責任的AI發展的重視。公司和政府越來越專注於AI的公平性、透明性和問責性。可解釋的AI(Explainable AI,XAI)將在未來扮演更重要的角色,使模型對人類更具理解性,並確保符合相關法規。

小結

雖然生成式人工智慧的初始熱潮似乎正在消退,但這項技術其實在特定領域已獲得肯定與重視,並進入更成熟的階段。未來的技術方向則朝著更具針對性的應用、更高效的運行以及負責任的發展。在應用面上將從追求泛用的“酷炫效果”轉向更實際地解決問題,並逐漸受到小型、專業化模型以及混合方案的青睞。

未來的發展將可能包括AI增強人類工作、融入更廣泛的企業流程、並聚焦於行業專用解決方案,而不是試圖涵蓋所有領域。這一演變將使AI對商業採用變得更加實用、可靠和有價值,並且強調倫理和可持續的增長。

- 【科技特寫】一人對決巨頭:Tom Turney與AI夥伴如何在7天內攀越Google技術高牆? - 2026/04/07

- NVIDIA擴展開放模型以推動下一波代理型AI、實體AI與醫療AI發展 - 2026/04/07

- AI 機器人如何落實安全性控制 - 2026/04/02

訂閱MakerPRO知識充電報

與40000位開發者一同掌握科技創新的技術資訊!