Posted By 創業小聚 on 1 月 15, 2024 in AIGC, AI關鍵技術, Llama 2, LLM, 案例研究, 特寫 |

作者:創業小聚特約編輯 葉子萱

(圖片來源:創業小聚自製)

生成式AI新創的吸金能力仍然不減。成立僅7個月的法國新創Mistral AI於11日宣布,完成由a16z領投4.15億美元(新台幣129.54億元)的A輪募資,估值達到20億美元(新台幣627.2億元)。

事實上,由Google DeepMind和Meta的前員工所成立的Mistral AI,才在今年6月的種子輪獲得1.13 億美元(新台幣35.44億元)的資金,究竟為何被那麼多人看好?

有人看準歐洲的Mistral AI會在LLM(大型語言模型)的訓練、生成式AI的建構與OpenAI、Meta等人展開競爭,而Mistral AI的關鍵就是「開源」。

Google DeepMind、Meta前員工認為開源是AI的核心,創立Mistral AI

「開源是我們的核心。」Mistral AI執行長Arthur Mensch說。

Arthur Mensch和共同創辦人Timothée Lacroi、Guillaume Lample從學生時期就認識了,當Arthur Mensch在DeepMind工作時,Timothée Lacroi和Guillaume Lample則在巴黎的Meta AI研究中心工作。

Mistral AI執行長Arthur Mensch。(圖片來源:Arthur Mensch linked in)

2022年他們看到OpenAI的GPT模型讓AI進入人們的生活,有了更多應用場景和機會。出於對OpenAI「閉源」的作法不認同,決定成立Mistral AI,以完全授權的Apache 2.0授權方式開源新的LLM模型。

說到開源模型,首先會想到的是Meta的Llama 2,但是Llama 2會根據使用者的規模和目的而有對應的限制規範,例如月活躍用戶超過7億則要Meta申請特殊授權。

在Apache 2.0授權下發佈的模型是一種開源許可證,除了版權外,對用戶的修改、使用、複製程式碼沒有任何限制。儘管交給開發者完全的開發能力,從資訊安全角度看待或許並不樂觀,但Mistral AI認為開源的重點也保障了作者的版權和利益,克服潛在的濫用。

Mistral AI的稀疏混合專家模型:Mixtral 8x7B,與同為開源的Llama 2相抗衡

Mistral AI的產品與其他LLM相似,希望能協助企業部署聊天機器人、搜尋引擎、線上輔導等AI驅動的產品。Mistral AI目前在Apache 2.0授權下發布的有兩款產品,提供使用者免費使用:

- Mistral 7B

Mistral AI首款產品只有70億個參數的「小」資料庫。運用了群組查詢注意力(GQA)加快推理速度,減少重複運算。

- Mixtral 8x7B

屬於稀疏混合專家模型(Sparse Mixture of Experts Model,SMoE):網路中的每個子模組都擅長處理特定類型的資料,經過訓練能夠根據輸入資料的特性分配任務給2個最合適的「專家」,再將個別的輸出整合成最終的輸出。根據官方的資料,相比同為開源的Llama 2 70B模型,Mixtral 8x7B推理速度是Llama 2 70B的6倍。

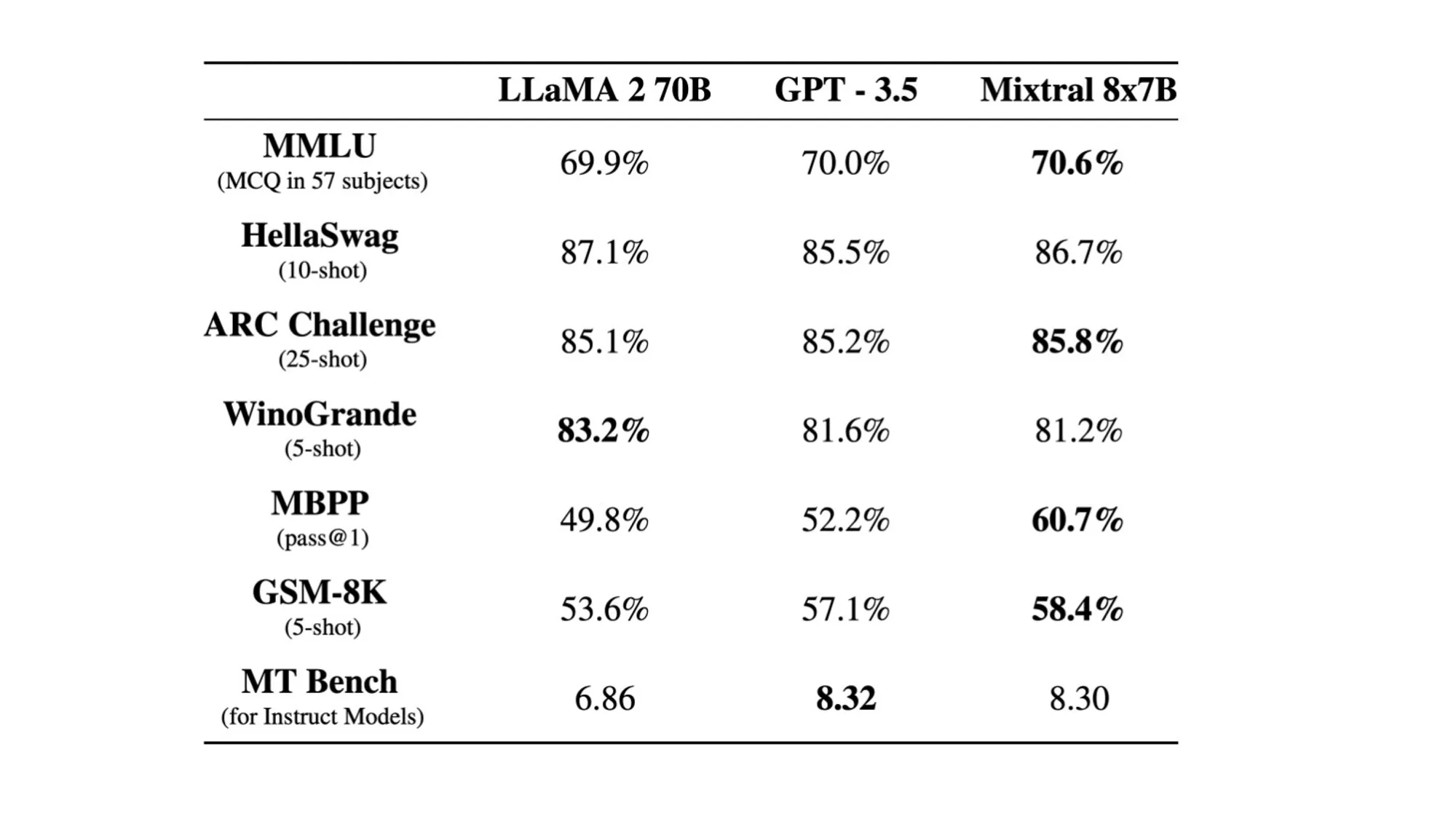

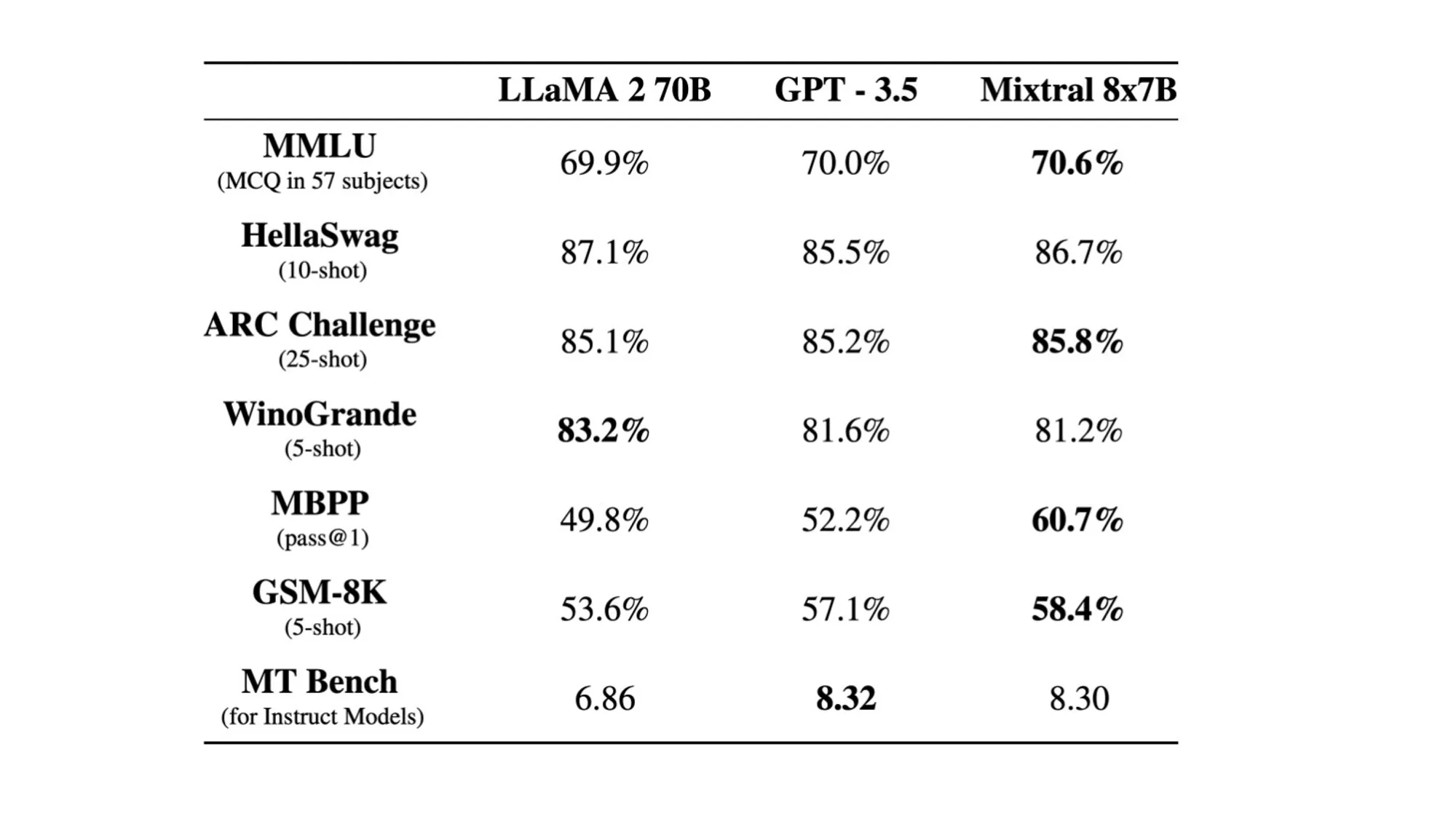

Misrtral AI的官方資料顯示:Mixtral 8x7B在大多數基準測試中,均符合或優於競爭對手Llama 2 70B以及GPT3.5。(圖片來源:Mistral AI官網)

Mistral AI近期也開放其他公司透過額外付費,使用Mistral AI當前的最佳模型:Mistral-medium。雖然沒透露更多細節,不過Mistral AI表示,未來將為企業開發託管解決方案和專用系統會是其主要獲利來源。

(本篇文章經同意轉載自創業小聚,原文連結;責任編輯:謝嘉洵。)

由《數位時代》自2011年起開始推動,透過跨平台的專業媒體以及交流月會、企業或投資媒合、國際參訪、創業競賽Neo Star Demo Show、新創展會Meet Taipei創新創業嘉年華等活動所打造的創新創業社群網絡,致力於促成資訊、資金、資源、人才、以及國際連結能夠廣泛交流與精準媒合。

訂閱MakerPRO知識充電報

與40000位開發者一同掌握科技創新的技術資訊!