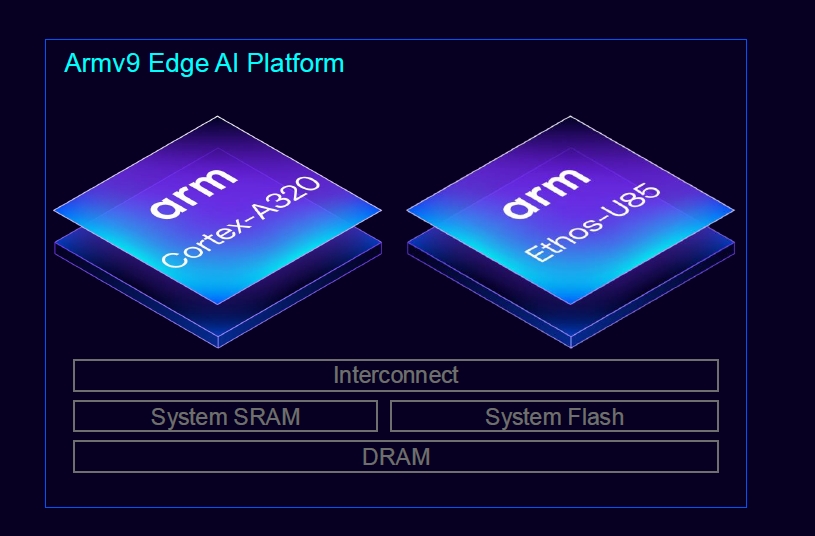

聚焦邊緣AI應用,Arm正式發佈其首個專為物聯網(IoT)裝置所開發的Armv9架構平台,以全新的Arm Cortex-A320 CPU和領先的邊緣AI加速器Arm Ethos-U85 NPU為核心,可支援運作超過10億個參數的邊緣端AI模型。新平台技術可應用於電腦視覺、語音辨識等多個應用場景,以及生成式AI的最佳化大型語言模型(LLM)或Agentic AI的系列小型語言模型(SLM)。

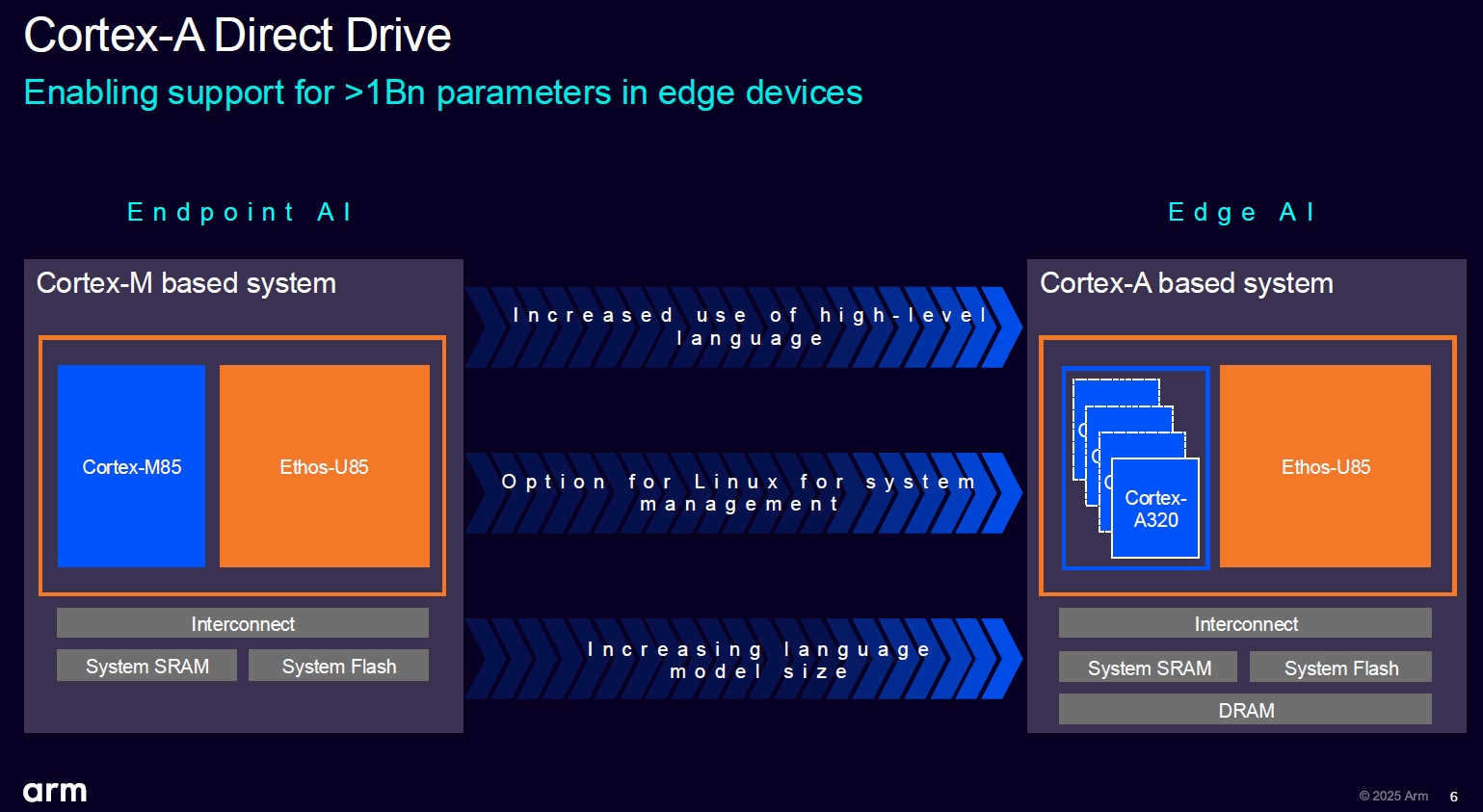

為了快速創新和擴展,OEM廠商需要在合適的位置靈活執行AI工作負載,以實現更強大的安全性和更高的軟體靈活性,Armv9 技術正是能在大規模應用中滿足這些需求的選擇。Armv9邊緣AI運算平台整合了Armv9架構 CPU核心Cortex-A320和支援 Transformer運算子網路的 Ethos-U85 NPU,相較於去年推出以Cortex-M85為基礎的平台,新的邊緣 AI 運算平台的機器學習(ML)效能提高了八倍。

Cortex-A320展現ML效能優勢 #

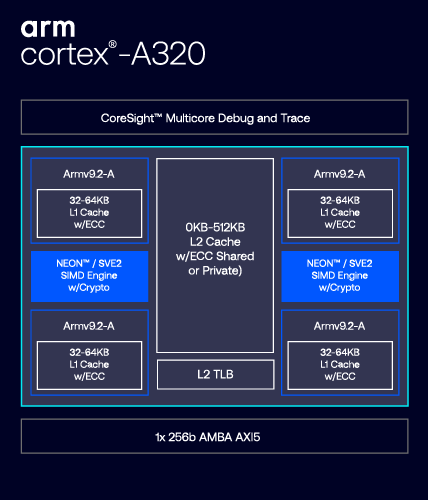

Cortex-A320 充分發揮了Armv9 架構的優勢,例如針對 ML 效能的 SVE2。相較於前代產品 Cortex-A35,Cortex-A320 的 ML 效能提升了十倍,純量效能提升了30%。該平台所採用的Armv9.2 架構還為最小的Cortex-A裝置帶來了先進的安全功能,例如指標驗證 (PAC)、分支目標識別(BTI)和記憶體標籤擴充(MTE)。這一功能相當重要,因為邊緣裝置通常在暴露的環境中運行並處理敏感性資料。隨著邊緣 AI 在 Arm 平台上持續整合,這一全新產品的加入使 Arm 現已能為物聯網提供最為先進的 Armv9 Cortex 處理器系列,範圍從極致效能到成本和電源受限的裝置。

邊緣 AI 普及所面臨的最主要障礙之一就是軟體發展和部署的複雜性,這正是 Armv9 邊緣 AI 運算平台軟體生態系可展現優勢的關鍵所在。Arm 將 Arm Kleidi 擴展到物聯網,這是一套針對 AI 框架開發人員的運算庫,其目標在於優化基於 Arm CPU 的 AI 和 ML 工作負載,無需開發人員額外操作。KleidiAI 已整合到常見的物聯網 AI 框架中,如 Llama.cpp 和 ExecuTorch 或 LiteRT(透過 XNNPACK),加速了 Meta Llama 3 和 Phi-3 等關鍵模型的效能。例如,在 Llama.cpp 上運行微軟的 Tiny Stories 資料集時,KleidiAI 為新的 Cortex-A320 帶來了高達 70% 的效能提升。

這些提升相當關鍵,因為在當今快節奏的技術環境中,產品的上市速度往往決定其成敗。新的邊緣 AI 運算平台確保了與高效能 Cortex-A 處理器在軟體層面的無縫相容。這種可擴展性使開發人員能夠打造可隨需求變化而靈活調整的解決方案。

#

#

小結 #

借助龐大的 Armv9 生態系,以及與 Linux 等功能豐富的作業系統和 Zephyr 等即時操作系統的相容性,開發人員擁有了更大的靈活性。他們可以充分運用現有的工具和知識,以及軟體重複使用的優勢,進而加快產品上市時間,並降低總體擁有成本。

該平台能夠支援在基於代理人的 AI 應用上運行經過調校的LLM和小型語言模型 SLM,進而開闢全新類別的邊緣應用場景。在未來的場景中,智慧決策將更接近資料獲取源頭,這不僅能大幅減少延遲,還能有效提升隱私保護水準。