作者:歐敏銓

LTX-2 不只是另一款技術模型,它標誌著「生成式影片」從邊緣試驗進入「廣泛創作/實務應用」的時代。對 Edge AI 開發者而言,LTX-2 則代表生成式 AI 已逐步邁向「可在本地運行、低延遲、可整合於實際應用管線」的新階段。

說起影片製作的未來,很多人仍在想像:若有一天,只需打字輸入、點選構圖,AI 便能產生電影級畫面與同步音效,而這一天似乎比預期還要早到!

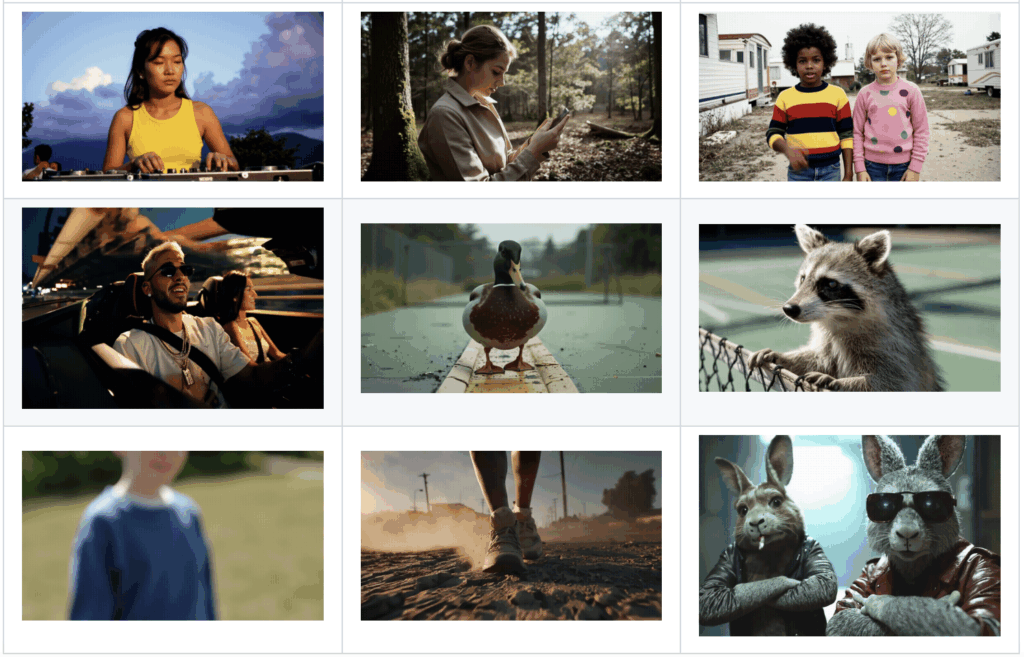

長年以 Facetune、Videoleap 等創作 App 聞名的 Lightricks於 2025 年 10 月 23 日正式發布 LTX-2,稱其為第一款完整開源的 AI 影片基礎模型,讓「從構想到影片、從靈感到可發布成品」之間的距離,又再縮短了一大步。

不同於以往雲端導向的生成框架,LTX-2 的研發重心在於運算效率與即時生成能力。官方指出,它在 2 秒內即可生成一張 1024×1024 影像,比同級模型快上數倍,並能保留視覺細節與語意一致性。這樣的速度不只是「快」,更代表 Lightricks 正試圖改寫生成式 AI 的使用場景:讓生成不再只是雲端任務,而是一種「互動即時體驗」。

它可以在短短5秒內生成一段風格化的高清6秒視訊,也能將原生音訊和視訊合成與開源透明度相結合,創作者可以透過幾乎即時輸出即時預覽來迭代他們的想法。該模型還能夠同時產生伴奏音訊——無論是配樂、對話還是環境音效——從而顯著加快創意工作流程。

該公司表示,如果用戶願意多等幾秒鐘,他們就可以將輸出增強到 4K 分辨率,最高可達每秒 48 幀。這樣的規格,在短片世代中已具備專業製作級的能力,更值得一提的是,創作者可以在消費級 GPU 上運行該軟體,從而大幅降低運算成本。

技術發展回顧

Lightricks 的 LTXV 系列,早在 2024 年便已經讓「文字/圖像到影片」的可能性浮上檯面。當時 LTX Studio 推出,可從文字提示、圖像、場景參考中產製影片。

今年7月,該公司的LTXV系列產品(包括LTXV-2B和LTXV-13B)率先支援長影片生成,先前的更新將輸出長度延長至60秒。借助此功能,AI視訊製作變得“真正自主”,用戶可以從初始提示開始,並在視訊直播過程中即時添加更多提示。用戶可以逐步透過模型添加更多色彩和細節來增強視訊效果,就像專業動畫師在傳統製作流程中在其作品上「分層」添加額外細節一樣。

13B 模型是基於Getty 和 Shutterstock 的授權資料進行訓練。該公司與這些內容巨頭的合作至關重要,這不僅是為了訓練資料的質量,也是出於道德方面的考慮;模型輸出的版權問題要小得多,而版權問題卻困擾著許多其他 AI 模型的創作。

Lightricks 也發布了 LTXV-13B 的精簡版,簡化並加快了傳播流程,只需四到八個步驟即可產生內容。精簡版還支援 LoRA,這意味著用戶可以對其進行微調,以創建更符合專案美學風格的內容。

而如今 LTX-2 不僅延續這條路,更將「音訊+視訊、4K 畫質、即時效能」—三者合一。當聽到「音樂、對話、動作影像一起生成」這樣的敘述時,你或許會想:「是不是只是短片試水?」「品質能追得上專業團隊嗎?」但它的定位卻更強:專為生產流程設計,支援從 6 秒構想片段到 10 秒長片段,還有高至原生 4K 、50 fps 的輸出。

舉個場景:假設一家品牌需要一支 30 秒的社交影片,他們可能在上午提交腳本提示,下午便能收到初版,隔天調整幾個關鍵影格,再在今天內交片。過去可能需數天、數週,這種效率提升、成本壓縮、創作者節奏加快,正是 LTX-2 的核心訴求。

背後技術細節

要理解 LTX-2 的魔力,得先往下探一點:它的技術基礎與架構設計。這不是純粹在功能上疊加,而是在底層重新建構。

LTX-2 的技術核心是對 潛變空間(latent space)壓縮與生成解碼 的再設計。Lightricks 團隊在多篇技術筆記中提到,它採用類似於 Stable Diffusion 的 UNet 架構,但經過重新優化的編碼器可在更低維度下保持圖像品質。此外,它支援 語意引導(semantic-guided diffusion),能更準確地理解文字提示,生成畫面時的語境與構圖也更貼近人類直覺。

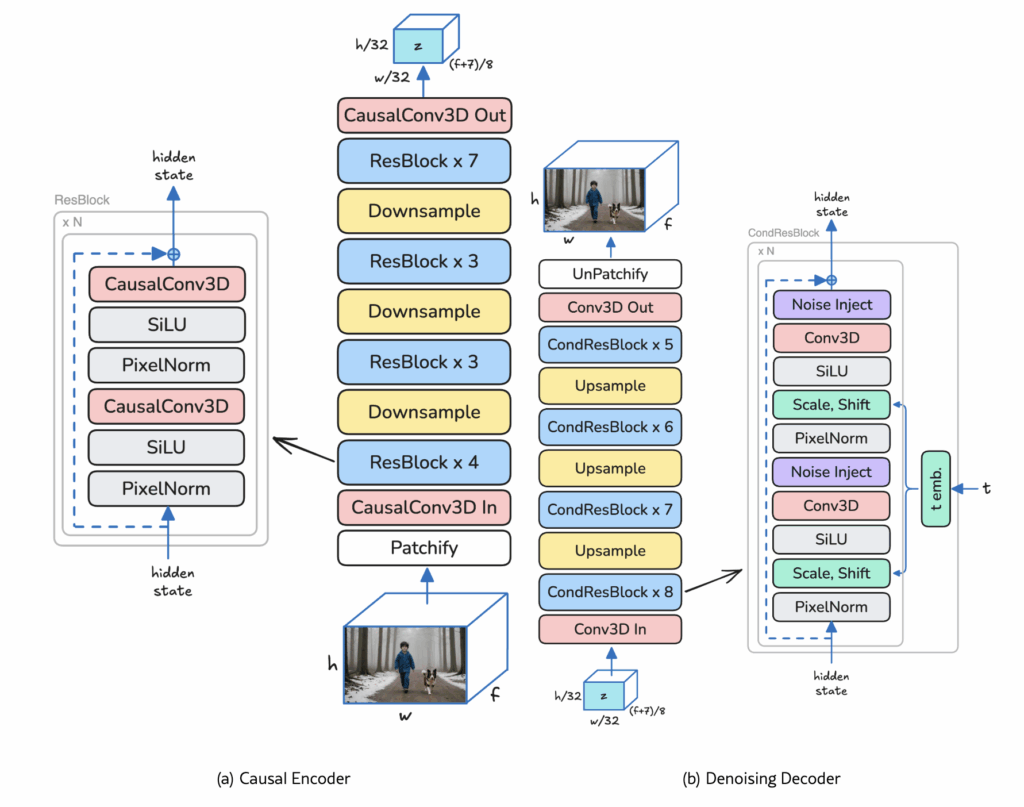

LTX-Video Video-VAE技術架構(source)

其核心技術包括:

- 混合擴散–變壓器架構 (hybrid diffusion–transformer):這意味著模型在生成過程中,融合了擴散模型(diffusion)與變壓器(transformer)的特性,專為速度、控制、效率而優化。

- 多 GPU 推理堆疊 (multi-GPU inference stack):生成並不是慢慢等待,而能做到「比 播放速度還快」的產出。這對於影片來說,是關鍵突破。

- 原生 QHD/4K 渲染 + 多尺度預覽:從低解析度快速預覽,再無縫升級至 4K 全品質版本,搭配 16:9 比例、高清紋理、流暢動態。

- 幀級精度 & 多關鍵影格調節:在場景控制上,導演可以操控 3D 攝影機邏輯、關鍵影格(keyframe)設定,甚至透過 LoRA 微調品牌風格/IP 風格。

- 多模態輸入與同步音訊:這是其中最具吸引力的一點:文字、圖像、視訊、音訊、深度圖等皆可作為輸入,且模型一次生成視訊與音訊,動作、對話、音樂同步出現。

更令人關注的是,LTX-2 強調「高效推論」而非龐大參數量。與動輒數十億參數的 Diffusion 模型相比,LTX-2 更傾向於小而快的方向,這也為其在行動裝置與邊緣平台部署鋪下了可行的基礎。

若說第一代生成式 AI 是在雲端「學會創造」,那麼 LTX-2 代表的則是——生成能力開始回到終端裝置手中。

Edge AI 啟示:當生成式模型走向邊緣

從 Edge AI 開發者的角度觀察,LTX-2 的推出不只是又一款影像生成模型,而是一個關於「生成速度、架構效率、與本地智能」的新訊號。LTX-2 支援 多模態輸入(文字、影像、視覺提示),並能根據語意自動生成或修飾畫面,這讓 Edge AI 開發者能想像更多結合生成式 AI 的使用場景,有三個值得特別關注的面向:

1. 模型壓縮與推論優化:

LTX-2 展示了如何在維持畫質的同時縮小模型體積,這對想在 Jetson Orin、Snapdragon X Elite、或蘋果 M 系列晶片上執行生成任務的開發者而言,是一個具體可參考的案例。這種高效結構意味著未來手機或 AR 眼鏡上,或許就能直接生成 AI 圖像或特效,而不必再仰賴雲端運算。

2. 多模態理解與語意生成:

LTX-2 可同時處理文字與影像提示,進行語意層級的畫面構建。這對 Edge AI 意味著更自然的人機互動:例如使用者透過語音指令說「讓這張照片更亮、更溫暖」,邊緣端模型即可立即生成修飾後影像,而不需上傳資料至雲端,既即時又兼顧隱私。

3.生成 + 辨識的雙向循環:

目前大多數邊緣AI任務集中於「辨識」(object detection、tracking),但生成模型如 LTX-2 可扮演資料擴增與視覺補強的角色。在智慧監控或工業檢測場景中,它能生成多樣化影像樣本以提升模型穩健性;在低光環境下,也能即時進行去噪與重建,提升辨識準確度。這種「生成輔助感知」的概念,正是 Edge AI 的下一階段。

為什麼「開源」這麼關鍵?

在 AI 影片生成的浪潮中,很多公司推出閉源、專有模型:你用他們平台、付費輸出,卻無法深入控制、調整、擴充。Lightricks 這次宣稱 LTX-2 是真正開源:模型權重、程式碼、基準將於 2025 年 11 月下旬公開至 GitHub ,開發者、研究者、工作室可自由探索、微調、構建。這有三個意義:

- 透明與信任:使用者可以檢視內部架構、調控參數,而不只是黑盒輸出。

- 自訂與品牌化:創作者可透過 LoRA 微調、品牌風格嵌入、控制攝影機邏輯,真正把影片「風格化為自己」而非套模板。

- 生態共創:開源後,學術界、開發社群、藝術家皆可進入討論、改進、衍生;影片生成技術不再被少數平台壟斷。

結論

LTX-2 不只是另一款技術模型,它標誌著「生成式影片」從邊緣試驗進入「廣泛創作/實務應用」的時代。當影片生成變得更快、更低門檻、更高畫質,創作者、團隊、品牌、教育機構皆可藉此擴展視界。

對 Edge AI 開發者而言,LTX-2 不只是另一個生成模型,而是一個訊號,代表生成式 AI 已逐步邁向「可在本地運行、低延遲、可整合於實際應用管線」的新階段。

未來幾年,我們可能會看到像 LTX-2 這類模型被移植進 Snapdragon X Elite、Apple M 系列、或 Jetson Orin NX 上,成為相機應用、AR 創作工具、甚至即時視覺增強系統的核心。

》延伸閱讀:

Introducing LTX-2: A New Chapter in Generative AI

Open-source AI video from Lightricks offers 4K, sound, and faster rendering

LTX-Video: Realtime Video Latent Diffusion(技術論文)

- 【產業觀察】Intel在VLA機器人市場的佈局與契機 - 2026/03/27

- AI如何讓機器人更有「人」味:跨越雙手協同鴻溝! - 2026/03/17

- 2026 Edge AI MCU技術趨勢與廠商方案現況比較 - 2026/03/12

訂閱MakerPRO知識充電報

與40000位開發者一同掌握科技創新的技術資訊!