作者:歐敏銓

在生成式 AI 競賽的洪流中,大家都盯著「更大、更強」的模型。然而,真正能落地、能在日常設備上運作的 AI 工具,往往不靠「龐大」取勝,而是靠「精準」取勝。Gemma 團隊在短短數月間連續推出 Gemma 3、Gemma 3 QAT 與 Gemma 3n,如今又帶來一款小巧卻強大的新成員——Gemma 3 270M。這款僅擁有0.27B參數的模型,有機會改寫邊緣運算與專業化 AI 的遊戲規則。

從 Gemma 3 到 270M:Gemmaverse 的進化

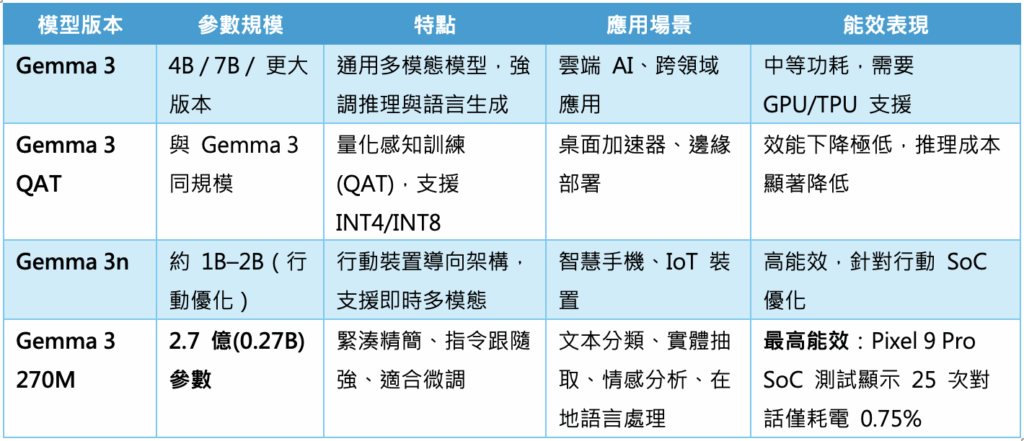

幾個月來,Gemma 的開放模型系列就像一場快速迭代的科技實驗。先是 Gemma 3 與 Gemma 3 QAT 在單雲與桌面加速器上展現高效能,再到以行動裝置為核心的 Gemma 3n,直接將即時多模態 AI 帶入邊緣設備。Gemma 不只是釋出模型,更是建構一個名為「Gemmaverse」的生態系。

根據官方統計,上週 Gemma 系列的下載量已突破 2 億次。這不僅是一個數字,更是一種信號:開發者社群正在積極採納 Gemma,並用它構建各式各樣的應用,從語音助手到教育工具,從內容生成到數據分析。

而今,Gemma 3 270M 的登場,讓這個宇宙變得更完整。它並非要挑戰「大模型」的霸權,而是明確瞄準「小而精」的專業化需求。

小身材,大智慧

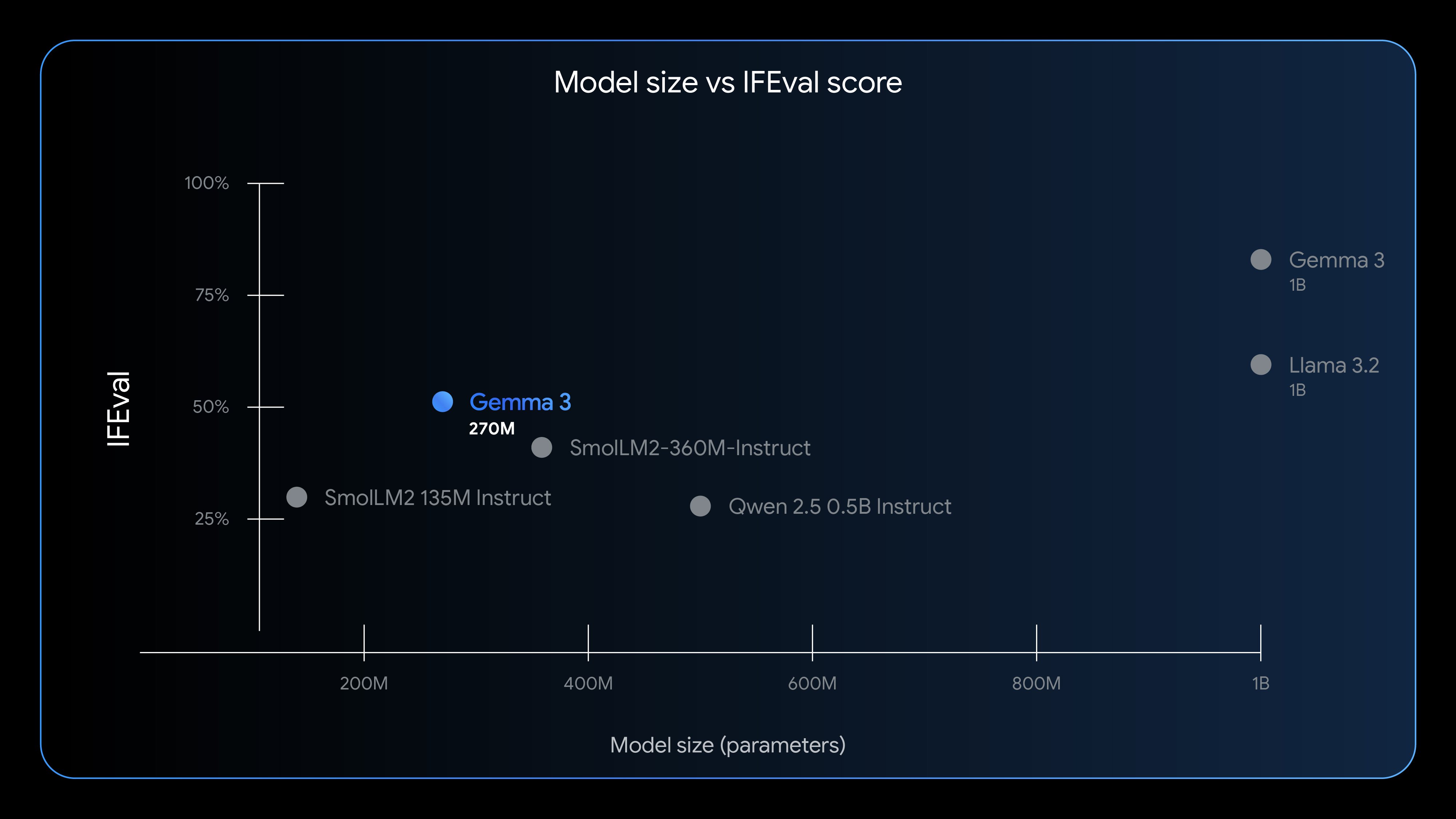

Gemma 3 270M 的名字直白地揭示了它的規模——2.7 億參數。乍聽之下,它遠不及數百億、甚至上千億參數的巨型模型,但這正是它的巧妙之處。

在這 2.7 億參數中,1.7 億用於詞嵌入,1 億用於 Transformer 模組。這樣的設計,配合高達 256k token 的龐大詞彙量,讓它能處理稀有的符號與語言細節,尤其適合特定領域的應用與在地語言的微調。

更令人驚訝的是它的能效表現。Google 在 Pixel 9 Pro SoC 上的測試顯示,Gemma 3 270M 的 INT4 量化版本,在進行 25 次對話時,僅消耗 0.75% 的電量。換句話說,它是 Gemma 系列迄今最節能的一款。這樣的特性,讓它在智慧型手機、IoT 裝置、甚至低功耗邊緣硬體上,都能長時間運作而不造成負擔。

工具的哲學:為對的任務選對的模型

一位 Gemma 工程師曾說過一句話:「你不會用大槌掛相框。」這句話道出 Gemma 3 270M 的哲學。

在 AI 的世界裡,越大的模型確實意味著更全面的能力,但同時也意味著更高的算力需求、更昂貴的運行成本,以及更長的部署週期。而現實中的任務,往往不需要「全能」,而是需要「準確」。

Gemma 3 270M 就是這樣的「小工具」:它能準確遵循指令,經過專業化調整後,能以高速與低成本完成文字分類、資料抽取、情感分析等明確定義的工作。它不會取代 GPT-4 或 Gemini Ultra,但它能成為某些專案的最佳選擇,讓工程師與研究人員用最有效率的方式完成任務。

真實案例:專業化勝過龐大

這種「小模型專業化」的策略,並非紙上談兵。

去年,Adaptive ML 與韓國電信巨頭 SK Telecom 合作,針對多語言內容審核這個極為複雜的任務,並沒有選擇成本高昂的巨型模型,而是對 Gemma 3 4B 進行微調。結果證明,專業化的 Gemma 模型不僅追上,甚至在特定場景中超越了更大型的專有模型。

這樣的成功,讓業界開始意識到「小模型大應用」的潛力。Gemma 3 270M 正是延續這條路徑的工具。它不僅適合企業級的內容審核、法規檢測,甚至能推動創新應用,例如一款能為孩子生成「睡前故事」的網頁應用程式。故事能根據孩子的名字、喜好或文化背景即時生成,並在手機上本地運行,無需將資料上傳雲端。這樣的 AI,不僅實用,也充滿人情味。

為誰而生?

那麼,什麼樣的場景最適合 Gemma 3 270M?

- 高容量、明確任務:像情緒分析、實體抽取、查詢路由、結構化處理與法規檢查,Gemma 3 270M 都能快速完成。

- 成本與速度敏感:在生產環境裡,每一毫秒的延遲都代表金錢,270M 透過輕量結構,讓推理成本大幅降低。

- 隱私至上:由於能完全在設備端運行,它能處理醫療、金融等敏感資料,而不用擔心資料上雲。

- 多模型併行:企業可以同時建立數個專業化模型,每個模型負責不同任務,而不會突破基礎建設的預算。

- 快速迭代:270M 模型體積小,能讓開發者在數小時內完成實驗,快速找到最佳解。

開始上手:從微調到部署

Gemma 團隊為 270M 提供了完整的工具鏈,讓開發者可以迅速採用:

- 取得模型:可在 Hugging Face、Kaggle、LM Studio、Ollama 甚至 Docker 上下載,包含預訓練與指令調整版本。

- 嘗試模型:支援 Vertex AI 與 llama.cpp、Keras、MLX 等推理框架,方便快速測試。

- 進行微調:可搭配 Hugging Face、UnSloth 或 JAX,幾小時內即可完成實驗。

- 部署:不論是 Google Cloud Run,或是本地環境,都能直接落地,形成專屬解決方案。

這種「即取即用」的設計,降低了進入門檻,也符合 Gemmaverse 一貫的精神:創新不分大小。

小模型時代來了

過去對生成式 AI 的討論幾乎被「大模型」壟斷。人們談的是百億、千億參數的能力極限,卻往往忽略了「落地應用」的真正需求。Gemma 3 270M 的推出,正好提醒我們:AI 的未來不僅僅在於更大,而在於更適合。

它可能不是舞台中央最耀眼的明星,但卻是實驗室、企業與開發者最可靠的工作夥伴。它能在智慧手機裡輕巧運作,也能在伺服器裡快速併行。它能成為創意應用的靈感,也能成為嚴謹任務的守門員。

正如 Gemma 團隊所言:「工欲善其事,必先利其器。」Gemma 3 270M 就是這樣一把小而鋒利的工具,等待著被放進開發者的工具箱,去雕琢屬於下一代 AI 的故事。

》延伸閱讀:

Introducing Gemma 3 270M: The compact model for hyper-efficient AI

Adaptive ML trains Gemma 3 for exceptional multilingual results

- 【產業觀察】Intel在VLA機器人市場的佈局與契機 - 2026/03/27

- AI如何讓機器人更有「人」味:跨越雙手協同鴻溝! - 2026/03/17

- 2026 Edge AI MCU技術趨勢與廠商方案現況比較 - 2026/03/12

訂閱MakerPRO知識充電報

與40000位開發者一同掌握科技創新的技術資訊!