2024 MAI 開發者大會以「Make AI a Reality」為精神,希望架起AI技術與應用的橋樑,廣邀開發社群先進擔任講者,2天共20場演講,為AI開發者及AI Maker們領路。探討主題涵蓋先進及實用 AI 工具、框架、平台技術;Edge AI開發環境、推論優化與佈建;熱門關鍵技術:Local LLM、RAG、NPU、GenAI…;創新與落地Edge AI應用。

接續陳縕儂副教授的「打造台版LLM的理由與挑戰」分享,邀請到CuboAi技術長梁子凌從AI服務公司的角度,談談他帶領CuboAi技術團隊將其服務的基礎架構從雲端轉移到邊緣端所面臨的挑戰,也就他所說的:「從雲端降落凡間的故事。」

雲端架構的起點

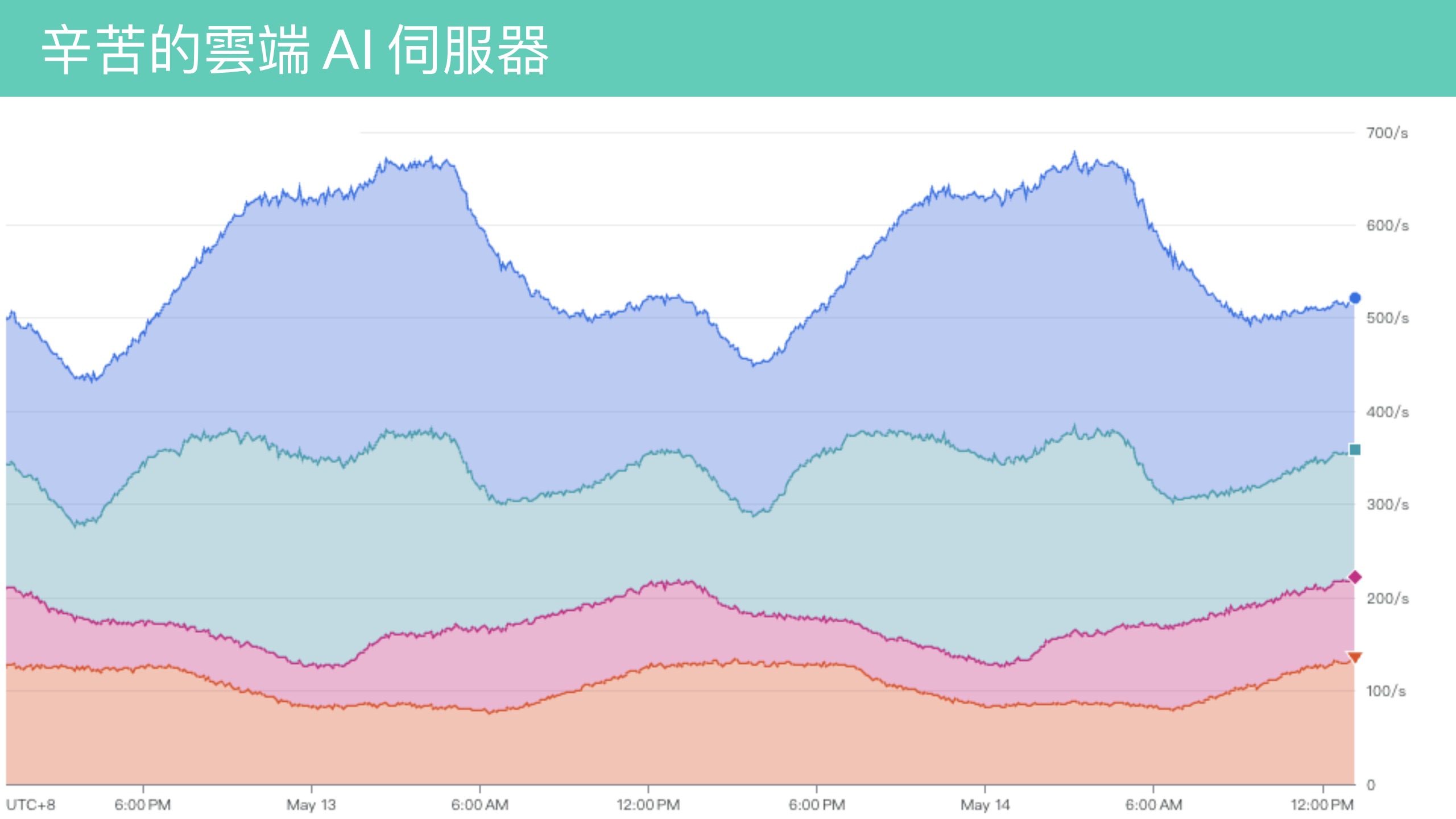

梁子凌首先介紹了CuboAi的初創背景,早期CuboAi使用雲端架構來處理全球超過一百多個國家的用戶數據。他說:「我們的服務就是用AI幫你看寶寶!」透過建立在美國、台灣和歐洲的AI伺服器群,處理大量來自網路攝影機的影片數據,即時回應全球父母親在工作之餘,希望看到子女即時動態的需求。

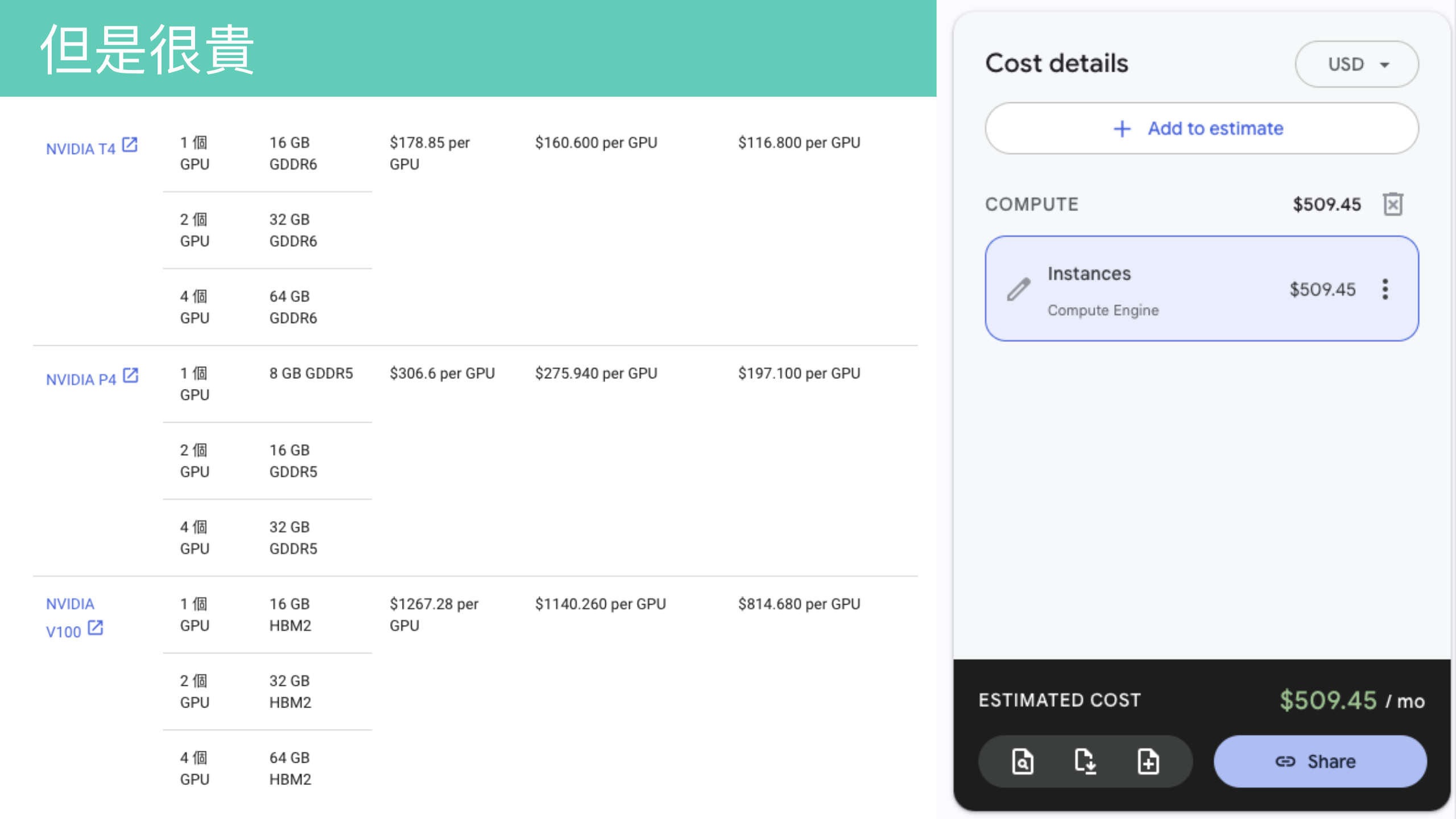

但是雲端架構也帶來了一些問題,包括高昂且持續性的伺服器成本問題。

從雲端到邊緣的動機與挑戰

隨著GPU Server技術進步(1分鐘服務4800次AI服務需求、每台GPU Server可以服務2400台攝影機,僅需$500美金/月)、和邊緣計算芯片的可用性,CuboAi開始考慮將部分運算從雲端轉移到邊緣設備。梁子凌說:「這樣做不僅僅減少伺服器成本,還可以提高處理效率。」

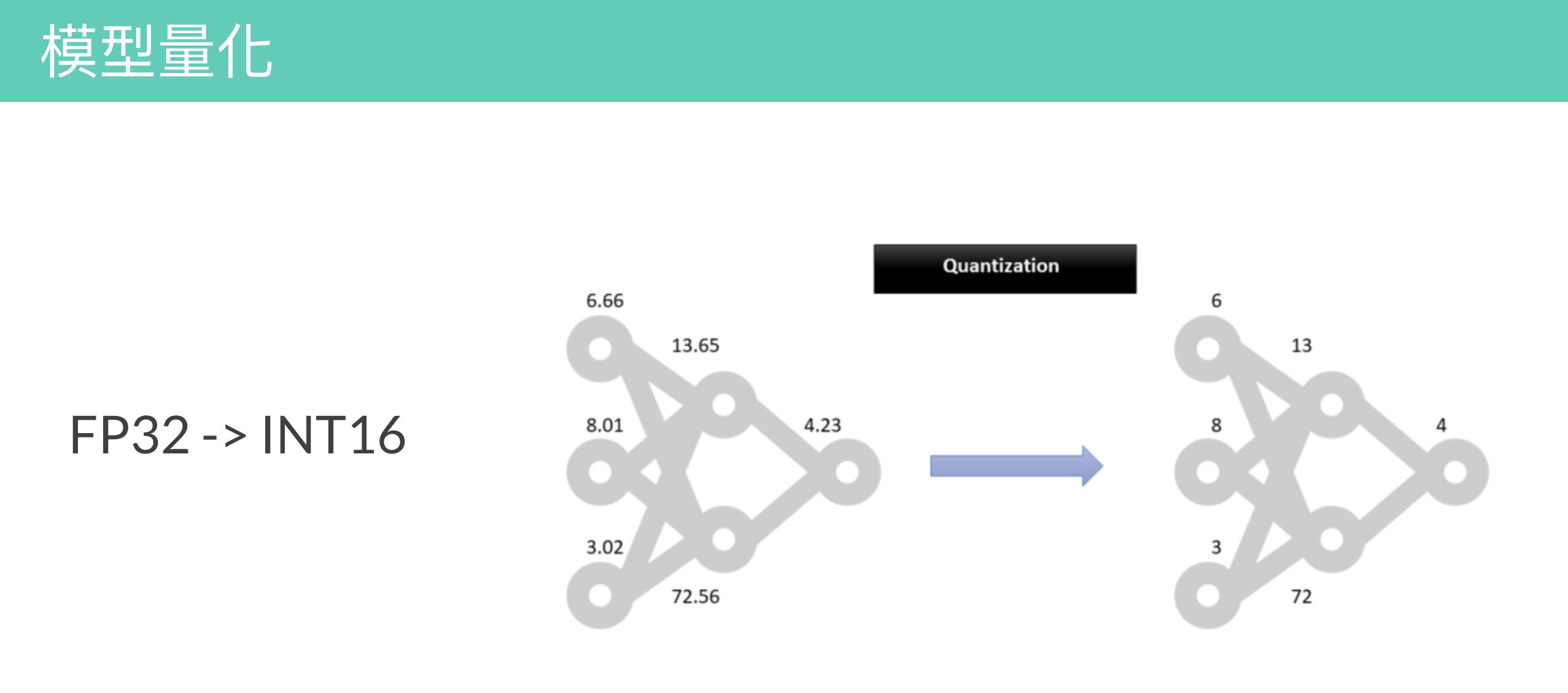

然而,想從從雲端降落凡間並不是件一蹴可及的事,特別是模型轉換的挑戰。大部分AI模型在訓練時使用32位浮點數,但邊緣設備的NPU通常只能處理整數,這需要進行浮點數模型到整數模型的量化處理。這會遇到浮點數和整數在表示的動態範圍上存在巨大差異,需精確處理模型中的參數範圍。

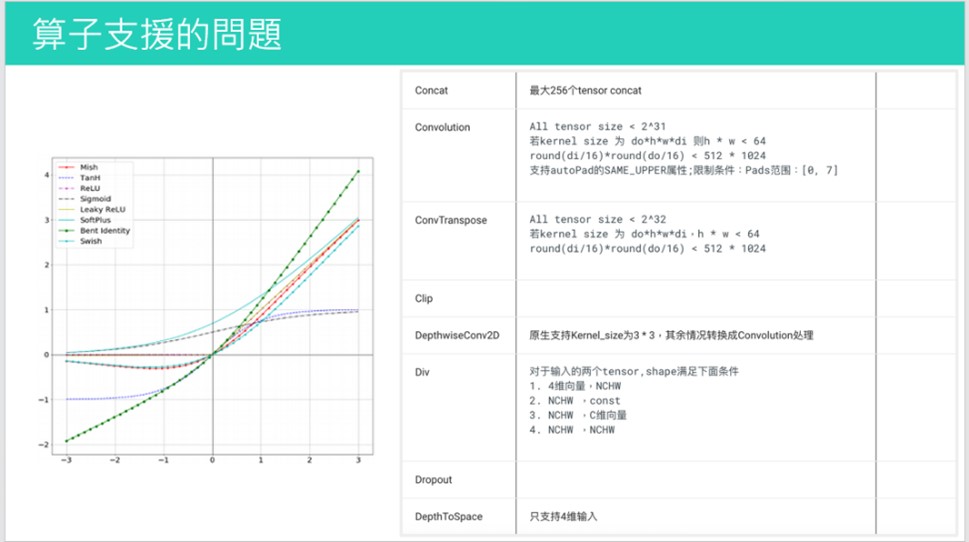

此外,不同平台的算子支持不同,這會導致一些模型在轉換過程中無法直接運行,需要重新訓練或調整模型。

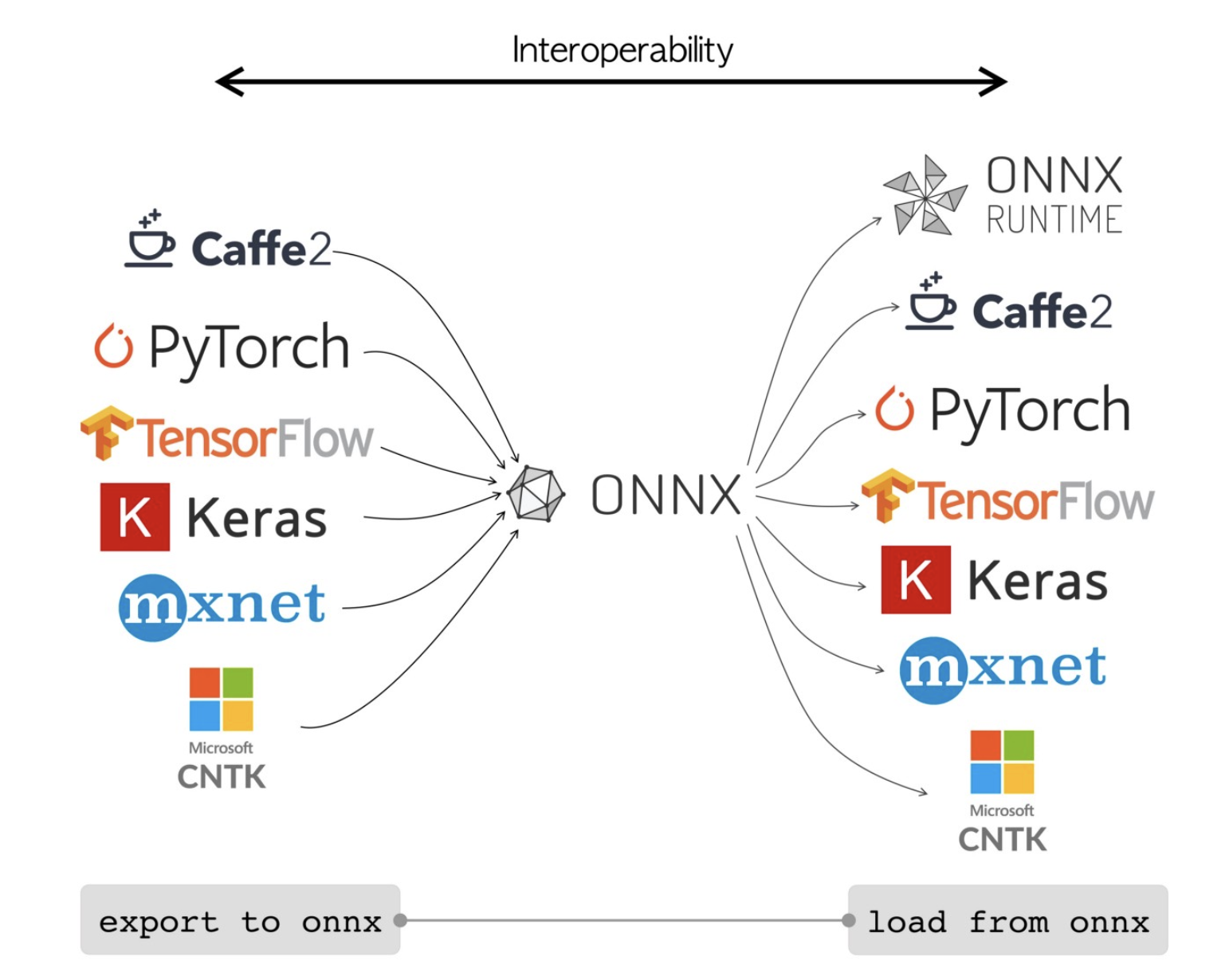

另一個轉移的挑戰是,從AI的訓練到推論,該選擇哪個開發框架或平台工具呢?為達成邊緣AI運算的目標,他們評估過各種平台提供的工具和模型轉換能力,並進行了實驗來確定平台的計算能力和內在限制,發現有的平台對某些模型好用,但換個模型就變差了,理想中的一統天下框架,恐怕還沒有出現。

在轉換過程中,CuboAi經歷了許多嘗試和失敗,才找到適合自己的邊緣運算作法。梁子凌發現:「通過合理選擇和調整模型,可以在邊緣設備上實現接近雲端運行效果的性能。」

未來展望

梁子凌總結了從雲端轉換到邊緣運算這過程中的利弊考量。他指出,邊緣運算雖然能夠降低成本和提高即時性,但也存在精度較低和運算資源彈性較差的問題。但他相信,隨著邊緣運算技術的進一步發展,這些挑戰在未來可望得到更好的解決。

- 台灣產業AI化調查:企業導入速度大躍進 AI治理為下一個轉型關鍵 - 2026/05/07

- 【Podcast】AI 進入教室:台灣教育現場的機會與挑戰 - 2026/05/07

- 【Podcast】重塑身體邊界:AI 與科技如何改寫「人類的形態」 - 2026/05/05

訂閱MakerPRO知識充電報

與40000位開發者一同掌握科技創新的技術資訊!