作者:陸向陽

《Intel® DevCup x OpenVINO™ Toolkit》AI創意競賽首獎30萬,正如火如荼徵件中(2021/10/31 23:59截止報名)!

近年來深度學習有各式各樣的嘗試應用,但各位可知道哪些應用受到看好與肯定?對此Intel於Hackster.io上發起過一次挑戰賽:Deep Learning Superhero Challenge,讓全球眾多深度學習開發者提交其提案與開發,從而給予獎勵。

挑戰賽共有三種獎項,一是大獎(Grand Prize):由專業評審選出;二是早鳥提交(Early Submission Prize)獎,鼓勵開發者儘快提交其作品;三是開發者票選獎(Developer Choice Prize)由最多人氣按讚者得。這些作品中有不少值得推薦的深度學習應用開發案例,本篇將針對盛大獎的優勝者作者進行觀察,下一篇再觀察精選獎以及若干的早鳥提交獎。

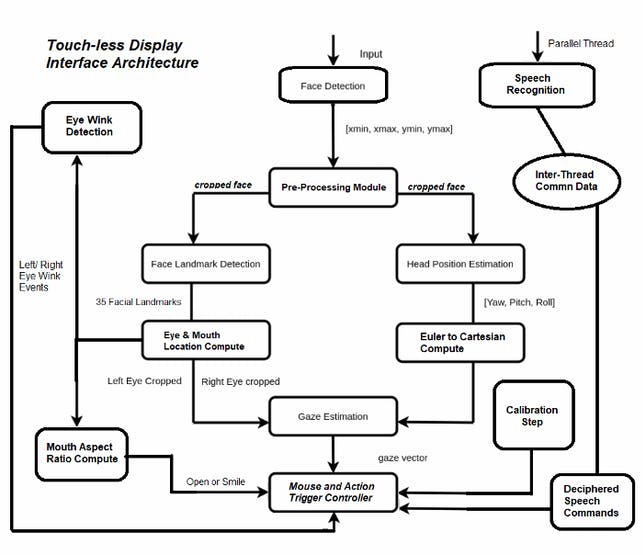

1. 非接觸式顯示器介面(Touch-less Display Interfaces on Edge)

現在有許多公眾服務系統需要觸控操作,例如超商的資訊服務亭(Kiosk,指7-11的ibon、全家的FamiPort)、博物館導覽、速食店點餐等,但COVID-19疫情關係這些觸控會帶來感染風險。

另一個痛點是,Apple Siri、Google Assist等語音助理雖能便利的用語音發問、語音回覆,但這是透過遠端連線在遠端進行話語判定與演算,如果斷線就無法使用。

因此提案者期望開發一套人機互動介面(Human-Computer Interaction, HCI)模組,模組可以智慧性搭組與執行多個AI模型,達到同時用多種方式,例如眨眼、眼睛視角的改變、頭方位的改變、手勢、語音(就近推論處理,不用遠端連線)等,來對特定裝置發令操控。

此提案用到樹莓派、樹莓派官方攝影機、Intel Movidius神經運算棒、耳機等,如果確定要使用語音控制則還需要搭配使用麥克風。

非接觸式操控架構圖。(圖片來源:hackster.io)

2. 芒果樹病蟲害偵測(Mango Plant Disease Detection)

透過影像辨識健康或生病的芒果樹。(圖片來源:hackster.io)

提案者自身擁有一個200多顆芒果樹的農場,但芒果樹容易遭受多種病害,而且會擴散蔓延,為此期望開發訓練出能透過無人機空拍影像,來辨識健康或生病的芒果樹,從而只針對病株使用藥劑,減少藥劑使用除了省成本也維護環境。

在實現技術上提案者用及Intel OpenVINO工具包、TensorFlow等,訓練與推論則是在配置Intel Xeon處理器的電腦上進行,作業系統為Ubuntu 18.04,TensorFlow 2.0用於模型訓練,推論則用上OpenVINO 20.4。由於是影像分類所以使用CNN演算。

提案者表示,由於OpenVINO能對推論運算工作進行最佳化,在他此次的應用開發中,使用最佳化與未使用,推論速度差距72倍以上,每張圖只要0.005秒就能完成辨識。

展望後續,提案者期望在空拍無人機上配置樹莓派搭配Intel神經運算棒(Neural Compute Stick,NCS)直接進行病蟲害識別工作,以及除了分辨健康與生病外,還能細分出是哪種病,如白粉病、枯死病等。

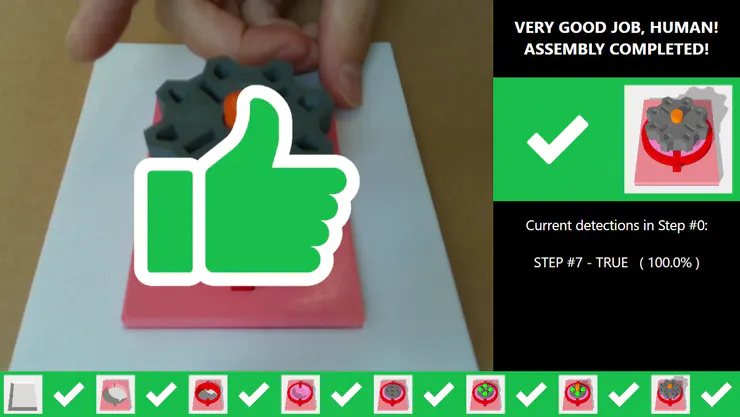

3. 產線裝配指導員(YWIL: the computer vision supervisor. You work, it looks)

提案名稱YWIL的全稱”You work, it looks”,意思是「你裝配,它來看」,它就是深度學習的模型。此提案期望給產業/工業/行業用的製造裝配員提供指導,裝配員組裝完成後,透過影像辨識,告知裝配員是否已是正確組裝,還是仍有偏差需要調整。

在開發過程中用及Intel Core i7-9750H高階處理器、Intel RealSense D435攝影機等硬體,軟體則為Intel OpenVINO工具包,另也用到公有雲服務,如Microsoft Azure的認知服務中的Custom Vision。

此外,由於需要一個典型的裝配零件過程,開發者自己用3D建模軟體設計一個零件,設計好後存成 .STL檔案格式、轉成G-code,然後透過3D列印製造,3D列印機為Original Prusa i3 MK2S。

YWIL顯示正確裝配的訊息。(圖片來源:hackster.io)

在訓練過程中開發者拍了約1,500張照片,然後標註約1,200張,訓練完成後用OpenVINO強化推論效率,實測結果每秒可到140個Frame,最低也有30個,因此開發者很推薦使用OpenVINO。

4. 自主機器人碰撞迴避系統(Collision Evasion System for Autonomous Robots)

適用於無人機、無人車的碰撞迴避系統。(圖片來源:hackster.io)

昂貴的碰撞迴避系統用到雷射光(用於測量實體距離/測距)、業者特定的導引模組等技術,不適合用在太小的無人車、無人機上,所以提案用深度學習的影像辨識方式實現平價的碰撞迴避功能。

此提案在硬體方面用到樹莓派、以Microsoft攝影機進行客製的雙攝影機、Intel第二代神經運算棒,軟體則有OpenCV、Intel OpenVINO工具包,另外也用ROS機器人作業系統模擬無人機、無人車。

由於沒有雷射測距儀,所以物體距離的深度改用OpenCV來研判,也因此需要兩組攝影機,類似運用人類兩眼角度視差來分辨遠近,另外也用到OpenVINO工具包內的MonoDepth。

能辨識景物遠近後,進一步才能開發迴避演算法,此次提案以無人機為主,若搭配MAVROS外掛程式則能用於無人車,演算法開發完成後也在軟體模擬器(Simulator)上進行測試驗證,依據模擬結果進一步調整修正,以便更貼近實務運用。

5. 人工智慧觸控螢幕(AI Based Touch Screen)

人工智慧觸控螢幕。(圖片來源:hackster.io)

此提案希望用一種便宜的方式達到與觸控螢幕一樣的效果,只要用攝影機拍攝人與白板,人用手指著白板某一位置,就形同拖動滑鼠游標,然後嘴巴發聲,就形同按下滑鼠左鈕、右鈕,能夠點按該處或叫出該處的對應選單。提案者期望把這一應用推廣到貧困國家、開發中國家的教育領域,取代傳統類比黑板。

此開發用到Intel處理器、麥克風、USB攝影機,以及可選用配置Intel第二代神經計算棒(NCS2),軟體方面使用Python程式語言、TensorFlow、Qt Creator、OpenCV,以及Intel OpenVINO工具包。

為了操作體驗能流暢開發者進行了一些取捨與微調,訓練上評估過1D CNN、2D CNN、1D CRNN等作法,然後使用ImageNet資料集等,整體訓練約花五天,整個開發約一個月,開發者對於硬體加速器(指神經運算棒)跟C++程式碼的整合相當容易,對此感到滿意。

小結

最後,以上五個Grand Prize得獲提案,是從360名參賽者、45組提案中評選出的,確實有其技術及應用上的特色。下篇文章將繼續介紹5個有趣的AI案例,請不要錯過了。

若你看過文章想動手實做,歡迎來參加Intel舉辦的《Intel® DevCup x OpenVINO™ Toolkit》創意競賽,還有高額獎金等你來拿喔。

(責任編輯:謝涵如)

- 樹莓派新鮮事:硬體價格調漲、1GB與3GB新版本策略 - 2026/05/28

- 創客新鮮事:Arduino Core轉向Zephyr、可查Token耗量的微型顯示器 - 2026/05/25

- 平價、低功耗 MCU 評估板 – MAX32662EVKIT開箱實測 - 2026/05/20

訂閱MakerPRO知識充電報

與40000位開發者一同掌握科技創新的技術資訊!