作者:高煥堂

當今主流AI是基於機器學習(ML),既然是學習就在於認知學的哲學範籌。但是為什麼許多人們在談論ChatGPT時,總是偏於數學演算法、大數據統計分析,而很少涉及認知學(Cognitive)中的「因果」、「果因」等思考及推理能力呢?所以,本文就從認知學來理解ChatGPT的魅力來源。

認知心理學與AI

從認知心理學而觀之,人類天生有三種推理能力:

- 歸納法(Inductive)

- 演繹法(Deductive)

- 溯因法(Abductive)

其中,溯因推理又俗稱為「果因推理」。它與歸納法(經驗判斷)和演繹法(邏輯推理)的最大區別是:溯因推理是從事實(結果)中回溯可能的緣由(原因),再假設這個原因為真時,事實是否能夠被檢驗,如果結果也為真,則推理成立。

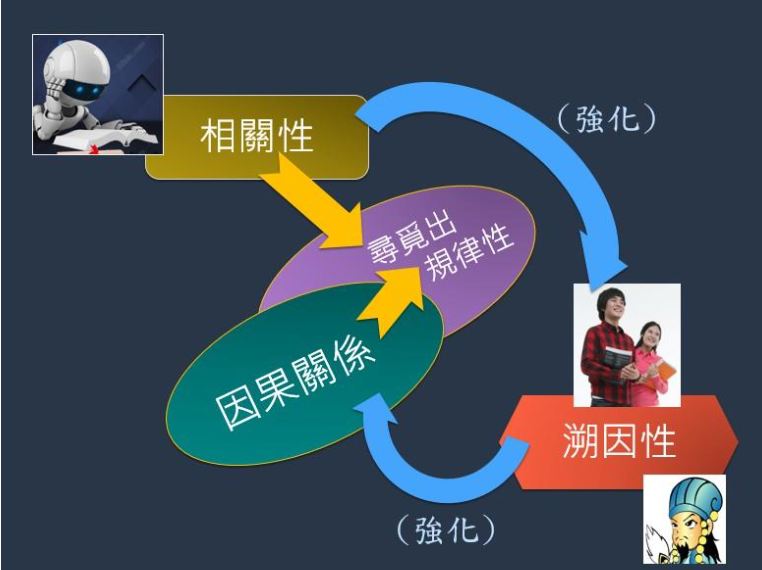

當今AI所仰賴大數據的相關性,只是低階的因果關係而已。由於,當今的AI對於因果關係的探索能力,還是非常有限的,仍然非常依賴人類(具有溯因性推理習慣者)來補足。人類具有溯因性推理習慣者,就是通稱的創新者,如愛因斯坦、諸葛亮等,其擅長於溯因:從果追溯其真實的因。

新一代的AI科學家們,正努力強化現在的AI,就是讓AI除了大數據相關性之外,能提升探索和掌握因果性的能力。可參閱這本書:

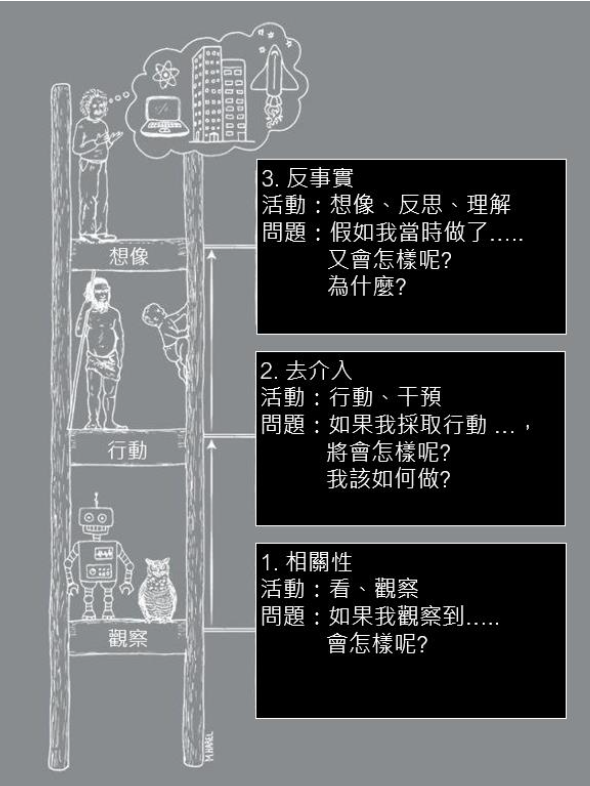

當今的AI只掌握最低層次的因果關係,如下圖:

當今的AI仍屬於第 1階的貓頭鷹階層。然而,目前AI已經非常強大的相關性探索力和歸納性推裡能力,我們如何善加利用來強化人類的果因性(即溯因性)推理能力。

一旦AI強大歸納推理力,強力搭配人類的果因性推理能力,則像醫生、股市、軍事等不確定性高的場域(偏於果因性推理),就都可迎刃而解了。熟諳此道的企業將成為AI時代的大贏家了。

AI擅長於「瞬間洞察」

為什麼ChatGPT 只能生成(Generative),而不能創新(Creative )呢? 因為ChatGPT 的生成是源於ML最基本的Predict功能。一般而言,Predict 的中文翻譯為「預測」,有窄化它的涵意之嫌。在ML裡,Prediction 含有推論(Inference )之意,也就是有「見微知著」的生成全貌的能力。

為什麼AI模型(如ChatGPT)具有生成全貌的能力呢? 當今AI是基於ML(機器學習),它會向人類學習。它向人類學習什麼呢?學習人類的做事、創物的經驗直覺。經驗直覺的邏輯是不清晰的,無法經由程式設計來寫成傳統的程式碼。

換句話說,上述的Prediction (即Inference)能力來自於學習(即訓練)。訓練它的閱歷愈豐富,其見微知著(即生成全貌)的能力愈好。例如,AI 看幾千張人類女生的照片,心中(即AI的隱藏空間)會留下顯著的印象:女生幾乎都穿高跟鞋,以及載耳環。

一旦訓練完成了,AI就銘記在心:女生幾乎都穿高跟鞋,又戴耳環。於是就有能力做預測(即推論)。例如,AI看到一張新照片,照片裡只有一隻腳穿高跟鞋(見微),它就推論出:這個人是女生,所以她也載耳環(知著)。於是AI就畫出女生的長相,並加上耳環,「生成」了一張完整的女生圖像。

也由於AI能使用更接近人類的「非邏輯化」方式去認識周遭的事物,包括人類看不到的(也因而無法邏輯化的)的複雜現象。所以AI從莎士比亞文學作品中,可以學習到人類所看不到的藝術創作(如非邏輯化部分)成分。

簡而言之,AI很擅長於學習人類專家的直覺性智慧(即專家直覺),也就是非邏輯性智慧。愈是資深的行業專家,其直覺性智慧愈豐富,表現於「瞬間洞察」的能力愈強。AI的「瞬間洞察」智力,已經達到IQ300以上,而人類天才的IQ才180。

所以ChatGPT驚動全人類,就是它從人類各種文字、圖像等作品學習其非邏輯性智慧,也直接吸納人類的專家直覺智慧,最後與人類專家(含非專家)對談來捕捉人類使用者的心意(Attention),來進一步強化其「貼心」能力。

所以ChatGPT驚動全人類,就是它從人類各種文字、圖像等作品學習其非邏輯性智慧,也直接吸納人類的專家直覺智慧,最後與人類專家(含非專家)對談來捕捉人類使用者的心意(Attention),來進一步強化其「貼心」能力。

AI需要大量、高質量的專家經驗直覺,來協助AI將其擅長的大資料歸納性推理,有效転化、串聯出強大的因果性邏輯推理。因之,掌握AI與企業領域專家(Domain expert )族群之間的銜接點,將會是未來10年新科技潮流的大驘家。

AI的特性:缺乏原生性「果因」推理能力

專家有豐富的經驗直覺。AI是機器學習,來向專家學習。例如,司馬光是專家,AI最主要是從司馬光的作品「資治通鑑」(對AI而言,作品即是大資料)中學習專家智慧(含風格、道、理等經驗直覺)。

ChatGPT 是基於ML(機器學習)的AI,其遺傳了ML的天生缺陷,就是:沒有原生性(Native )的「溯因推理」能力。也就是缺之俗稱的「果因性推理」天賦。

就如同一位小孩,還沒自己賺錢的能力。他(她)需要依賴別人(如爸媽)給他錢,他才有經濟「消費能力」。簡而言之,ML模型的果因性推理能力是「拿來主義」,它天生欠缺自發性(原生性)的成新陳代謝、成長和修補功能。

其緣由是:當基於ML的AI,都缺乏「反事實(anti-facts)思考」的能力。亦即俗稱的:假設(Hypothesis )思考能力。通常,一個人(或動植物)若缺之假設性思考力,就沒有原創力(創新力)。因之,ChatGPT 在成長階段(即機器學習階段)需要仰賴人類提供給它「溯因推理邏輯(規律)。於是,人類就提供「專家經驗直覺」給ChatGPT ,協助它建構完整的推理思考機制,呈現出令人驚豔的AIGC創作力。

由於AI在未來200年內,即可能都缺乏果因性推理能力。因而,它愈強大、對專家直覺的需求愈大,將愈需要專家直覺來提供果因推理。例如,中醫師就是大家熟悉的專家,醫師專家觀察病狀(果),然後把其病源(因)告訴AI。AI擅長從觀察(問聞望)的症狀(果)進行歸納。但AI 的天生缺點是:沒有果因推理能力。

剛好專家的「切」,斷出其因,把專家果因推理真覺,添補進去AI 模型裡。於是AI就具備了「對症下藥」的”切”能力了。然後再依因果推理,而預測對症下葯之後的健康復原狀態了。如果沒有專家直覺的注入,AI只是一個統計回歸分析演算法而已!

Al可以從字面上找出很豐富的人事時地物之複雜關聯。這是過去傳統IT做不到的。人們只要擅加挖掘及發揮這新技術的能量,即可創造許多讓人驚奇的情境和效果。由於AI這項能力已遠遠地超越人類了,咱們只要找到觸發點,就能輕輕揮灑、四兩撥千斤、產生巨大能量和效果。

尋找觸發點的手段之一就是尋找AI與人類之間的能力互補性。AI具有超強的能力,在極為複雜情境裡,迅速探索事物和現象的關聯性。然而AI的極端弱點是,它沒有能力進行「反事實的假設性」推論。AI這項弱點,也凸顯出人類的優點,以及互補點。

AI的關聯性 + 人們的果因性推論 = 真實的因果性

小結

華夏文化傳統中,大多偏於關聯思維。文藝復興之後,西方注入了更多果因思維,因而發現許多關聯背後潛藏的因果律,科學探索逐漸蔚為風潮。關聯性基於事實的表徵觀察和符號紀錄,例如:象形文字。果因性(溯因性)基於假設和檢驗,挖掘表徵背後的潛在因數。

例如,觀察到整個村莊都沒有人感染天花疾病(果),關聯到乳牛,繼續假設性探索與檢驗,確定「牛逗」是關鍵因數。於是發現了因果律,謂之:科學發明。

(本文文章引自高煥堂在北京「電子產品雜誌」的連載文章;責任編輯:謝嘉洵。)

- LoRA微調三步驟:以大語言模型MT5為例 - 2024/05/02

- 為什麼Gemma採取Decoder-Only Transformer架構呢? - 2024/04/08

- 如何從0訓練企業自用Gemma模型 - 2024/04/03

訂閱MakerPRO知識充電報

與40000位開發者一同掌握科技創新的技術資訊!