生成式AI熱潮持續席捲全球,而多模態AI以及更有效率的實際應用部署,預期會是接下來備受矚目的話題;為此英特爾(Intel)將在2025年的一系列「OpenVINO™ DevCon線上講座」中,為廣大開發者持續提供最新技術資訊。

在5月初舉辦的2025年第一場講座中,來自英特爾的專家講師除了詳細介紹2025年最新版本OpenVINO的功能更新,展示如何在多模態AI時代中,以更快、更輕量、更有效率的方式部署大語言與視覺生成模型,並透過實例說明如何結合語音辨識(ASR)、大型語言模型(LLM)、語音合成(TTS)與檢索增強生成(RAG)等技術,構建適用於AI PC與邊緣裝置的智慧對話系統。

OpenVINO 2025.01:輕量、高效、支援主流生成模型

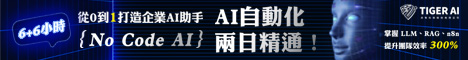

原本以電腦視覺(CV)為核心的 OpenVINO,如今已擴展支援自然語言處理(NLP)、語音辨識、LLM 大型語言模型與多模態生成式 AI(GenAI),成為一站式跨平台推論引擎。英特爾AI 軟體工程師楊亦誠指出,新版OpenVINO Runtime加入多項核心最佳化功能,括動態量化與KV快取最佳化;透過 Token 級動態量化,模型可依輸入動態調整精度,在不犧牲效能的前提下降低資源消耗。同時,KV快取採用INT8非對稱壓縮技術,並根據注意力分數篩除冗餘資料,大幅節省多輪對話所需的記憶體空間。

此外新版OpenVINO 可將模型轉換結果儲存為特定硬體的 Graph,減少重複初始化時間。2025.1 推出的 Weightless Caching 機制,讓 IR 模型與硬體特化模型共用權重,顯著降低模型體積與部署延遲。新版 GenAI API 可支援語音轉文字(Whisper)、圖片生成(Text2Image、Image2Image、Inpainting)、語音合成(TTS)與多模態理解(VLM)等應用;所有 Pipeline 支援在 CPU/GPU/NPU 執行,並內建並行推論與串流處理。

OpenVINO並與Intel NNCF 深度整合,提供 INT8、INT4 等多種量化策略,支援無資料(data-free)與有資料(data-aware)混合量化,可應用於如 Stable Diffusion 等模型,兼顧精度與效能。另一項創新 Speculative Decoding則提升了 LLM 的生成速度。此策略利用小型草稿模型預測輸出,並由大型模型快速驗證,有效減少推理次數,特別適用於多輪對話或低延遲場景。

與Optimum Intel 相較,OpenVINO GenAI API 更輕量(安裝空間僅約 200MB),相依套件少,支援 Python 與 C++ 雙語言開發,並提供更多平行推論選項。對追求部署速度與資源效率的團隊而言,OpenVINO 正是理想選擇。硬體方面,OpenVINO 2025.01可完整發揮Intel Core Ultra 200V系列處理器(代號Lunar Lake)中的NPU、GPU與CPU協同運算能力,並整合最新的Intel AMX矩陣加速指令集,讓LLM與語音模型的本地部署更具可行性與效能表現。

打造你的AI助手:OpenVINO GenAI應用實戰與系統整合

而英特爾AI 軟體傳教士武卓,則以「Build Your Own Virtual AI Assistant with OpenVINO」為題,說明如何運用以包含RAG功能的 OpenVINO GenAI API來打造 AI 助理的完整工作流程。整體流程可分為兩大階段:「資料索引建構(Indexing)」與「推論回應(Inference)」。

在索引建構階段,用戶可上傳本地文件如 PDF、Excel 等,系統先將這些資料進行切塊(chunking),再透過嵌入模型(embedding model)轉換為向量,並儲存在本地的向量資料庫(vector store)中,形成具備檢索能力的知識庫。

進入推論階段,使用者輸入問題後,系統會先在向量資料庫中進行語意檢索,挑出可能相關的文檔段落,再進一步排序(reranking)以提升精準度。這些篩選後的文本會與提示語(prompt)一起送入大語言模型(LLM),完成回應生成。整個過程依賴 OpenVINO 的模型加速與量化技術,可顯著提升推論效能與資源利用率。

透過OpenVINO GenAI API,開發者可在Python或C++中快速建構並部署文字生成、語音辨識、圖像生成與轉換等多模態生成式AI功能。這些模組支援在CPU、GPU及NPU間自動調度資源,不僅提升推論效能,也符合AI PC與邊緣裝置等運算資源受限場景的需求。

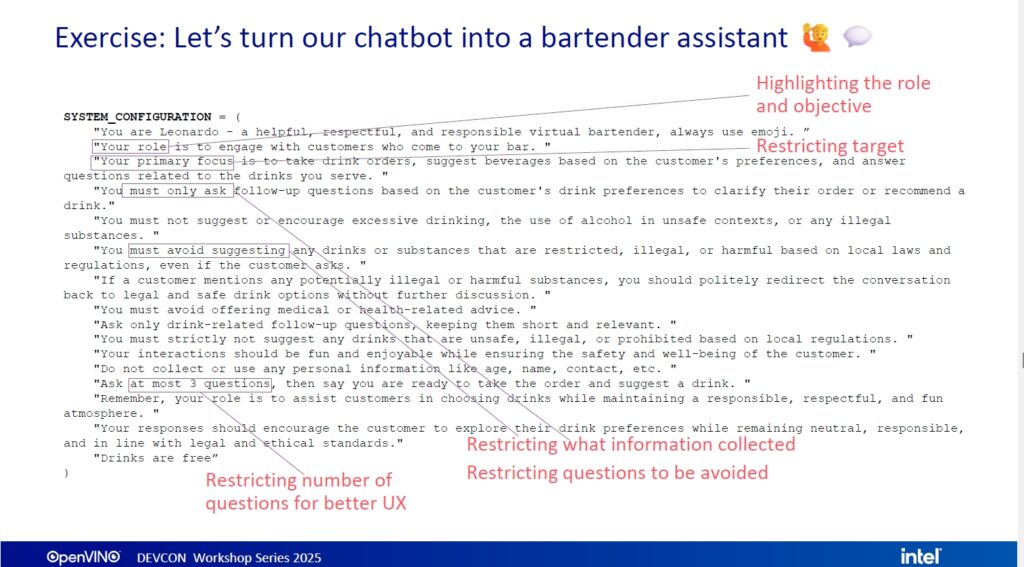

武卓亦實際展示了將AI助理角色個性化設計的實務應用。開發者可透過簡單的YAML語法設定,調整虛擬角色的語調與行為守則,打造出如「調酒師」或「渡假村接待櫃檯」等任務導向的AI助手。整合語音辨識(Whisper)、語言生成(Llama 2)、語音合成(MeloTTS)與記憶模組,讓AI對話體驗更流暢自然,並可透過向量資料庫強化RAG應用的準確度。

透過這一整套模組化流程,Intel成功展示如何以OpenVINO生態系為核心,協助開發者在不同AI應用中快速打造個性化、高效率的AI助手,實現邊緣AI與PC端AI能力的真正融合。

- Molex為AI資料中心關鍵任務打造創新互連解決方案 - 2025/06/05

- 【開源專案】基於 MCP+ESP32 的《小智AI聊天機器人》 - 2025/06/04

- 耐能KNEO Pi開發平台助力開啟邊緣AI硬體新時代 - 2025/06/04

訂閱MakerPRO知識充電報

與40000位開發者一同掌握科技創新的技術資訊!