參賽團隊名稱:IKEA派我來的

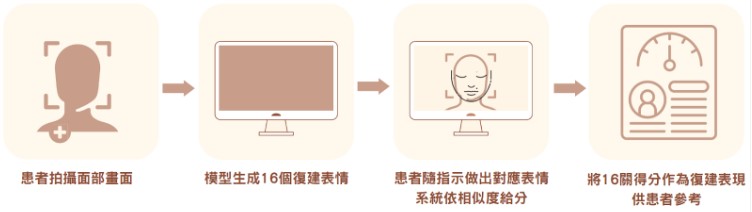

運用現行 AI 模型,開發顏面神經失調復健系統,透過表情生成和面部比對,精準追蹤患者復健狀況。

提案動機

顏面神經失調患者在高度密集的復建後能復原近全部的面部機能;若是錯過治療黃金期,可能留下不可回復的傷害。

除了給予患者類固醇、電療、針灸等治療外,復建師也需要引導患者做出豐富表情。但患者可能因復建中心距離遙遠或療程費用太高等因素,降低復建頻率。

我們將優化目標聚焦在低延遲的復建體驗、客製化療程和確保成效。

- 便利性 : 以 web 的形式推出的復健方式,大幅提升患者復健的便利性,無論居住於偏遠地區或都市的患者皆可以在家就完成復建。

- 客製化:用 deepfake 技術掃描患者的面部,反推出療程中需做出的表情(例如:挑眉、皺眉),貼近患者在不同療程階段中的實際情況。

- 高成效:模型比較患者做出的表情和目標 landmark 的重合程度,提供患者和醫生準確的成效數據,例如:進步幅度和本次得分。

解決方案

解決方案

- 使用 OpenVINO Optimizer 轉換模型

- 使用 OpenVINO Benchmark 測試環境

- 行動裝置攝影機獲取使用者正面照片

- Ganimation 模型:將照片轉換成16張不同臉部動作單元之照片

- face_mesh 模型:在人臉和目標表情照片上抓取輪廓和器官的位置

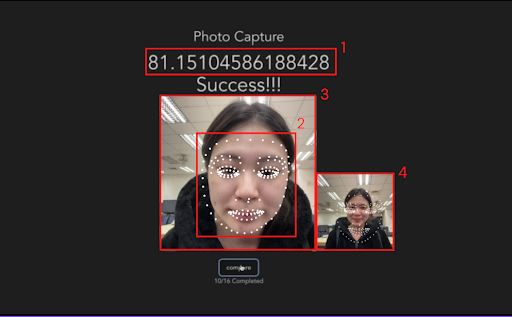

- landmark_accuracy 運算:比對目標表情以及鏡頭內使用者之器官位置差異,兩者做相似度比對

成果介紹

成果介紹短片 :

Facial Paralysis Solver 共分成三個部分。

第一階段模型為生成不同表情的 Ganimation,根據心理學家 Paul Ekman 的研究成果,人的臉部表情可以歸類成40多種不同的臉部動作單元 ( AUs ) 的組合,團隊預先收集了 100 張臉部癱瘓患者的照片,透過 Openface 找出屬於癱瘓特徵的 AUs,將其和使用者的照片一齊輸入 Ganimation,生成 16 張擁有不同表情的新照片,多數產出的表情照片能看出大笑和皺眉等常見復健動作。

在第二階段中,獲得置換後的不同表情照片後,我們期待使用者能以照片的復健表情為目標,訓練其臉部動作,於是我們選用了 Facemesh 模型,找出人臉的器官位置標記,將其和使用者攝影機畫面持續做比對,並在一旁提供目標表情圖片,提示使用者目標復原表情。

最後一階段,我們根據臉部器官的相對位置和大小,將使用者實時表情與復建表情的差距轉換成分數,表示使用者訓練的完成度。同時,系統亦會根據五官位置來提示使用者做出抬眉毛等調整。最後系統會將本次訓練之整體表現呈現給使用者。

上述的兩個模型 Ganimation 和 Facemesh ,皆使用了 OpenVINO 所提供的 Model Optimizer 將 onnx 模型轉換成 IR Model 方便做後續對於終端機器的優化。

團隊自介

我們是一群來自政大資管系的好夥伴,指導教授為郁方教授,這是我們第一次挑戰AI領域的競賽,希望可以得到大家的肯定。

參考資料 :

GitHub – vipermu/ganimation: Pytorch implementation of GANimation with pretrained weights.

如果真的可以完成這個計畫將會幫助很多患者及中風失能的病人,再也不用大老遠去醫院復健,透過系統也可以很有效率的完成復建進度,後台資料若能即時紀錄,透過健保系統和醫療單位合作及線上回覆醫囑就更棒了!

非常棒

好強

我只覺得這個團隊裡面的蘇希甫,他不只是是一位富有科學洞察力的資管學生,更具有獨特的風格,使這個比賽增添了精彩的競爭,因此我是非常看好這隻隊伍的