參賽團隊名稱:SandBox

提案動機

因應疫情影響,人們購物時穿衣碰觸到的服飾都有著感染的隱患,透過虛擬試衣讓我們能夠在不碰觸物體的狀況下達到換衣的效果,除此之外,還能夠解決到試衣間脫衣換衣的麻煩 !

解決方案

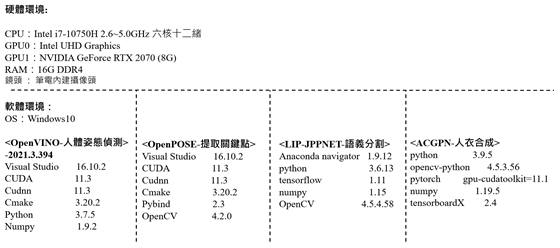

開發環境:

由攝像頭拍攝人像圖片,利用OpenVINO Toolkit 中的human pose estimation demo取得人像關鍵點,再由OpenPOSE提取出關鍵點的.JSON檔,接著使用LIP-JPPNET進行語義分割,最後將原圖、關鍵點JSON檔、語義分割結果、要換之衣物圖像皆輸入至ACGPN進行推論,即能得出換衣結果。

成果介紹短片

成果介紹

參考資料:

實時鏡頭抽幀處理

https://github.com/amjltc295/VITON_realtime

人體關鍵點

https://github.com/CMU-Perceptual-Computing-Lab/openpose

人物解析-語義分割

https://github.com/Engineering-Course/LIP_JPPNet

ACGPN模型