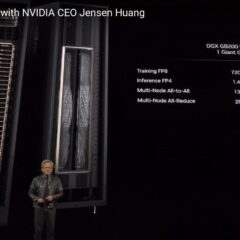

Nvidia GTC 2024 提出的 FP8/FP4 如何加速AI訓練及推論

新一代 GPU Blackwell B200 在硬體端提供了 FP4 計算能力,單片就可達 20 petaFLOPS,二片 B200 組成的 GB200 在訓練性能是前一代 H100 的 4 倍,推論性能更高達 7 倍。若再將 36個 CPU 加上 72 個 GPU 組成「GB200 NVL72」超大型伺服器,則 FP8 訓練能力可高達 720 petaFLOPS, FP4 推論能力更高達1.44 exaFLOPS。而究竟什麼是 FP8 / FP4 呢?本篇文章會簡單幫大家科普一下。

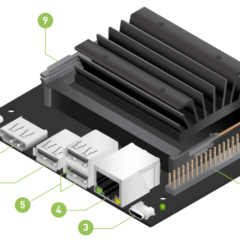

【CAVEDU講堂】在Jetson Nano 2GB 燒錄系統映像檔

本文將引領對AI有興趣,想要跨入AI領域的初學者進入NVIDIA Jetson Nano 2GB的世界,從映像檔燒錄開始,針對如何設置Jetson Nano 2GB進行教學。

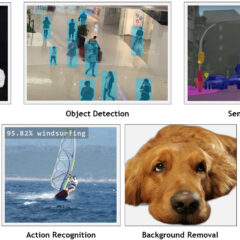

【AI工具教學】你的YOLOv5模型不夠快?用TensorRT來加速吧!

TensorRT是NVIDIA Jetson系列的深度學習模型加速工具,能最佳化硬體、提高效能,適應不同運算精度,並優化模型結構。影片中介紹TensorRT的使用,特別強調YOLOv5轉換、如何操作及其卓越加速效果。

【CAVEDU講堂】如何將Jetson Nano透過網路線固定IP連線

本文將介紹如何在常用於機器學習和人工智慧開發的Jetson Nano單板電腦上,設定有線固定內網伺服器和DHCP,以便在內部網路中輕鬆連接和管理。

【CAVEDU講堂】Jetson Orin Nano 邊緣運算電腦執行 Jetson Inference 深度學習影像函式庫

本文將說明如何在 Jetson Orin Nano 上安裝 Jetson Inference即時影像深度網路函式庫,使用了 TensorRT 來在 GPU 上執行各種最佳化後的神經網路模型。